mirror of

https://github.com/LCTT/TranslateProject.git

synced 2025-02-25 00:50:15 +08:00

commit

6d4670f990

@ -1,18 +1,18 @@

|

||||

如何通过反向 SSH 隧道访问 NAT 后面的 Linux 服务器

|

||||

================================================================================

|

||||

你在家里运行着一台 Linux 服务器,访问它需要先经过 NAT 路由器或者限制性防火墙。现在你想不在家的时候用 SSH 登录到这台服务器。你如何才能做到呢?SSH 端口转发当然是一种选择。但是,如果你需要处理多个嵌套的 NAT 环境,端口转发可能会变得非常棘手。另外,在多种 ISP 特定条件下可能会受到干扰,例如阻塞转发端口的限制性 ISP 防火墙、或者在用户间共享 IPv4 地址的运营商级 NAT。

|

||||

你在家里运行着一台 Linux 服务器,它放在一个 NAT 路由器或者限制性防火墙后面。现在你想在外出时用 SSH 登录到这台服务器。你如何才能做到呢?SSH 端口转发当然是一种选择。但是,如果你需要处理多级嵌套的 NAT 环境,端口转发可能会变得非常棘手。另外,在多种 ISP 特定条件下可能会受到干扰,例如阻塞转发端口的限制性 ISP 防火墙、或者在用户间共享 IPv4 地址的运营商级 NAT。

|

||||

|

||||

### 什么是反向 SSH 隧道? ###

|

||||

|

||||

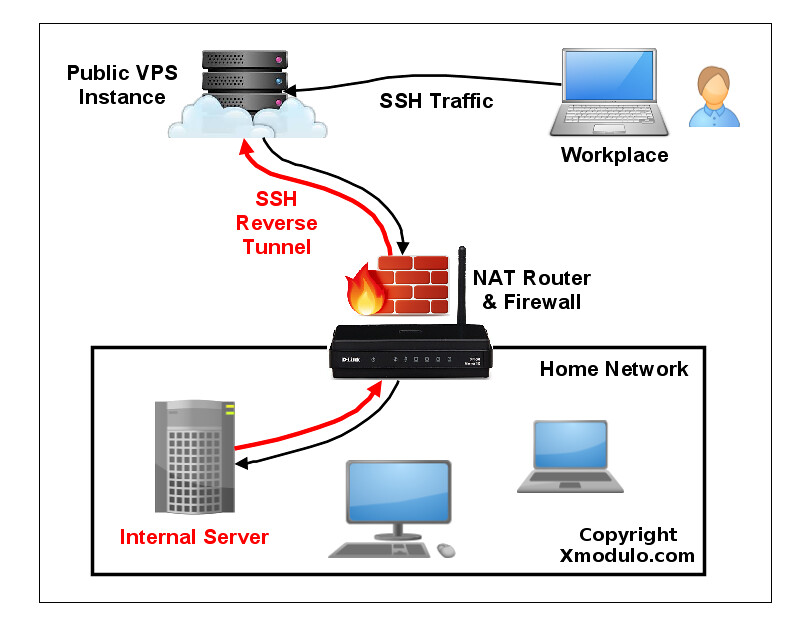

SSH 端口转发的一种替代方案是 **反向 SSH 隧道**。反向 SSH 隧道的概念非常简单。对于此,在限制性家庭网络之外你需要另一台主机(所谓的“中继主机”),你能从当前所在地通过 SSH 登录。你可以用有公共 IP 地址的 [VPS 实例][1] 配置一个中继主机。然后要做的就是从你家庭网络服务器中建立一个到公共中继主机的永久 SSH 隧道。有了这个隧道,你就可以从中继主机中连接“回”家庭服务器(这就是为什么称之为 “反向” 隧道)。不管你在哪里、你家庭网络中的 NAT 或 防火墙限制多么严重,只要你可以访问中继主机,你就可以连接到家庭服务器。

|

||||

SSH 端口转发的一种替代方案是 **反向 SSH 隧道**。反向 SSH 隧道的概念非常简单。使用这种方案,在你的受限的家庭网络之外你需要另一台主机(所谓的“中继主机”),你能从当前所在地通过 SSH 登录到它。你可以用有公网 IP 地址的 [VPS 实例][1] 配置一个中继主机。然后要做的就是从你的家庭网络服务器中建立一个到公网中继主机的永久 SSH 隧道。有了这个隧道,你就可以从中继主机中连接“回”家庭服务器(这就是为什么称之为 “反向” 隧道)。不管你在哪里、你的家庭网络中的 NAT 或 防火墙限制多么严格,只要你可以访问中继主机,你就可以连接到家庭服务器。

|

||||

|

||||

|

||||

|

||||

### 在 Linux 上设置反向 SSH 隧道 ###

|

||||

|

||||

让我们来看看怎样创建和使用反向 SSH 隧道。我们有如下假设。我们会设置一个从家庭服务器到中继服务器的反向 SSH 隧道,然后我们可以通过中继服务器从客户端计算机 SSH 登录到家庭服务器。**中继服务器** 的公共 IP 地址是 1.1.1.1。

|

||||

让我们来看看怎样创建和使用反向 SSH 隧道。我们做如下假设:我们会设置一个从家庭服务器(homeserver)到中继服务器(relayserver)的反向 SSH 隧道,然后我们可以通过中继服务器从客户端计算机(clientcomputer) SSH 登录到家庭服务器。本例中的**中继服务器** 的公网 IP 地址是 1.1.1.1。

|

||||

|

||||

在家庭主机上,按照以下方式打开一个到中继服务器的 SSH 连接。

|

||||

在家庭服务器上,按照以下方式打开一个到中继服务器的 SSH 连接。

|

||||

|

||||

homeserver~$ ssh -fN -R 10022:localhost:22 relayserver_user@1.1.1.1

|

||||

|

||||

@ -20,11 +20,11 @@ SSH 端口转发的一种替代方案是 **反向 SSH 隧道**。反向 SSH 隧

|

||||

|

||||

“-R 10022:localhost:22” 选项定义了一个反向隧道。它转发中继服务器 10022 端口的流量到家庭服务器的 22 号端口。

|

||||

|

||||

用 “-fN” 选项,当你用一个 SSH 服务器成功通过验证时 SSH 会进入后台运行。当你不想在远程 SSH 服务器执行任何命令、就像我们的例子中只想转发端口的时候非常有用。

|

||||

用 “-fN” 选项,当你成功通过 SSH 服务器验证时 SSH 会进入后台运行。当你不想在远程 SSH 服务器执行任何命令,就像我们的例子中只想转发端口的时候非常有用。

|

||||

|

||||

运行上面的命令之后,你就会回到家庭主机的命令行提示框中。

|

||||

|

||||

登录到中继服务器,确认 127.0.0.1:10022 绑定到了 sshd。如果是的话就表示已经正确设置了反向隧道。

|

||||

登录到中继服务器,确认其 127.0.0.1:10022 绑定到了 sshd。如果是的话就表示已经正确设置了反向隧道。

|

||||

|

||||

relayserver~$ sudo netstat -nap | grep 10022

|

||||

|

||||

@ -36,13 +36,13 @@ SSH 端口转发的一种替代方案是 **反向 SSH 隧道**。反向 SSH 隧

|

||||

|

||||

relayserver~$ ssh -p 10022 homeserver_user@localhost

|

||||

|

||||

需要注意的一点是你在本地输入的 SSH 登录/密码应该是家庭服务器的,而不是中继服务器的,因为你是通过隧道的本地端点登录到家庭服务器。因此不要输入中继服务器的登录/密码。成功登陆后,你就在家庭服务器上了。

|

||||

需要注意的一点是你在上面为localhost输入的 SSH 登录/密码应该是家庭服务器的,而不是中继服务器的,因为你是通过隧道的本地端点登录到家庭服务器,因此不要错误输入中继服务器的登录/密码。成功登录后,你就在家庭服务器上了。

|

||||

|

||||

### 通过反向 SSH 隧道直接连接到网络地址变换后的服务器 ###

|

||||

|

||||

上面的方法允许你访问 NAT 后面的 **家庭服务器**,但你需要登录两次:首先登录到 **中继服务器**,然后再登录到**家庭服务器**。这是因为中继服务器上 SSH 隧道的端点绑定到了回环地址(127.0.0.1)。

|

||||

|

||||

事实上,有一种方法可以只需要登录到中继服务器就能直接访问网络地址变换之后的家庭服务器。要做到这点,你需要让中继服务器上的 sshd 不仅转发回环地址上的端口,还要转发外部主机的端口。这通过指定中继服务器上运行的 sshd 的 **网关端口** 实现。

|

||||

事实上,有一种方法可以只需要登录到中继服务器就能直接访问NAT之后的家庭服务器。要做到这点,你需要让中继服务器上的 sshd 不仅转发回环地址上的端口,还要转发外部主机的端口。这通过指定中继服务器上运行的 sshd 的 **GatewayPorts** 实现。

|

||||

|

||||

打开**中继服务器**的 /etc/ssh/sshd_conf 并添加下面的行。

|

||||

|

||||

@ -74,23 +74,23 @@ SSH 端口转发的一种替代方案是 **反向 SSH 隧道**。反向 SSH 隧

|

||||

|

||||

tcp 0 0 1.1.1.1:10022 0.0.0.0:* LISTEN 1538/sshd: dev

|

||||

|

||||

不像之前的情况,现在隧道的端点是 1.1.1.1:10022(中继服务器的公共 IP 地址),而不是 127.0.0.1:10022。这就意味着从外部主机可以访问隧道的端点。

|

||||

不像之前的情况,现在隧道的端点是 1.1.1.1:10022(中继服务器的公网 IP 地址),而不是 127.0.0.1:10022。这就意味着从外部主机可以访问隧道的另一端。

|

||||

|

||||

现在在任何其它计算机(客户端计算机),输入以下命令访问网络地址变换之后的家庭服务器。

|

||||

|

||||

clientcomputer~$ ssh -p 10022 homeserver_user@1.1.1.1

|

||||

|

||||

在上面的命令中,1.1.1.1 是中继服务器的公共 IP 地址,家庭服务器用户必须是和家庭服务器相关联的用户账户。这是因为你真正登录到的主机是家庭服务器,而不是中继服务器。后者只是中继你的 SSH 流量到家庭服务器。

|

||||

在上面的命令中,1.1.1.1 是中继服务器的公共 IP 地址,homeserver_user必须是家庭服务器上的用户账户。这是因为你真正登录到的主机是家庭服务器,而不是中继服务器。后者只是中继你的 SSH 流量到家庭服务器。

|

||||

|

||||

### 在 Linux 上设置一个永久反向 SSH 隧道 ###

|

||||

|

||||

现在你已经明白了怎样创建一个反向 SSH 隧道,然后把隧道设置为 “永久”,这样隧道启动后就会一直运行(不管临时的网络拥塞、SSH 超时、中继主机重启,等等)。毕竟,如果隧道不是一直有效,你不可能可靠的登录到你的家庭服务器。

|

||||

现在你已经明白了怎样创建一个反向 SSH 隧道,然后把隧道设置为 “永久”,这样隧道启动后就会一直运行(不管临时的网络拥塞、SSH 超时、中继主机重启,等等)。毕竟,如果隧道不是一直有效,你就不能可靠的登录到你的家庭服务器。

|

||||

|

||||

对于永久隧道,我打算使用一个叫 autossh 的工具。正如名字暗示的,这个程序允许你不管任何理由自动重启 SSH 会话。因此对于保存一个反向 SSH 隧道有效非常有用。

|

||||

对于永久隧道,我打算使用一个叫 autossh 的工具。正如名字暗示的,这个程序可以让你的 SSH 会话无论因为什么原因中断都会自动重连。因此对于保持一个反向 SSH 隧道非常有用。

|

||||

|

||||

第一步,我们要设置从家庭服务器到中继服务器的[无密码 SSH 登录][2]。这样的话,autossh 可以不需要用户干预就能重启一个损坏的反向 SSH 隧道。

|

||||

|

||||

下一步,在初始化隧道的家庭服务器上[安装 autossh][3]。

|

||||

下一步,在建立隧道的家庭服务器上[安装 autossh][3]。

|

||||

|

||||

在家庭服务器上,用下面的参数运行 autossh 来创建一个连接到中继服务器的永久 SSH 隧道。

|

||||

|

||||

@ -113,7 +113,7 @@ SSH 端口转发的一种替代方案是 **反向 SSH 隧道**。反向 SSH 隧

|

||||

|

||||

### 总结 ###

|

||||

|

||||

在这篇博文中,我介绍了你如何能从外部中通过反向 SSH 隧道访问限制性防火墙或 NAT 网关之后的 Linux 服务器。尽管我介绍了家庭网络中的一个使用事例,在企业网络中使用时你尤其要小心。这样的一个隧道可能被视为违反公司政策,因为它绕过了企业的防火墙并把企业网络暴露给外部攻击。这很可能被误用或者滥用。因此在使用之前一定要记住它的作用。

|

||||

在这篇博文中,我介绍了你如何能从外部通过反向 SSH 隧道访问限制性防火墙或 NAT 网关之后的 Linux 服务器。这里我介绍了家庭网络中的一个使用事例,但在企业网络中使用时你尤其要小心。这样的一个隧道可能被视为违反公司政策,因为它绕过了企业的防火墙并把企业网络暴露给外部攻击。这很可能被误用或者滥用。因此在使用之前一定要记住它的作用。

|

||||

|

||||

--------------------------------------------------------------------------------

|

||||

|

||||

@ -121,11 +121,11 @@ via: http://xmodulo.com/access-linux-server-behind-nat-reverse-ssh-tunnel.html

|

||||

|

||||

作者:[Dan Nanni][a]

|

||||

译者:[ictlyh](https://github.com/ictlyh)

|

||||

校对:[校对者ID](https://github.com/校对者ID)

|

||||

校对:[wxy](https://github.com/wxy)

|

||||

|

||||

本文由 [LCTT](https://github.com/LCTT/TranslateProject) 原创翻译,[Linux中国](http://linux.cn/) 荣誉推出

|

||||

|

||||

[a]:http://xmodulo.com/author/nanni

|

||||

[1]:http://xmodulo.com/go/digitalocean

|

||||

[2]:http://xmodulo.com/how-to-enable-ssh-login-without.html

|

||||

[3]:http://ask.xmodulo.com/install-autossh-linux.html

|

||||

[2]:https://linux.cn/article-5444-1.html

|

||||

[3]:https://linux.cn/article-5459-1.html

|

||||

@ -1,53 +1,54 @@

|

||||

Autojump – 一个高级的‘cd’命令用以快速浏览 Linux 文件系统

|

||||

Autojump:一个可以在 Linux 文件系统快速导航的高级 cd 命令

|

||||

================================================================================

|

||||

对于那些主要通过控制台或终端使用 Linux 命令行来工作的 Linux 用户来说,他们真切地感受到了 Linux 的强大。 然而在 Linux 的分层文件系统中进行浏览有时或许是一件头疼的事,尤其是对于那些新手来说。

|

||||

|

||||

对于那些主要通过控制台或终端使用 Linux 命令行来工作的 Linux 用户来说,他们真切地感受到了 Linux 的强大。 然而在 Linux 的分层文件系统中进行导航有时或许是一件头疼的事,尤其是对于那些新手来说。

|

||||

|

||||

现在,有一个用 Python 写的名为 `autojump` 的 Linux 命令行实用程序,它是 Linux ‘[cd][1]’命令的高级版本。

|

||||

|

||||

|

||||

|

||||

Autojump – 浏览 Linux 文件系统的最快方式

|

||||

*Autojump – Linux 文件系统导航的最快方式*

|

||||

|

||||

这个应用原本由 Joël Schaerer 编写,现在由 +William Ting 维护。

|

||||

|

||||

Autojump 应用从用户那里学习并帮助用户在 Linux 命令行中进行更轻松的目录浏览。与传统的 `cd` 命令相比,autojump 能够更加快速地浏览至目的目录。

|

||||

Autojump 应用可以从用户那里学习并帮助用户在 Linux 命令行中进行更轻松的目录导航。与传统的 `cd` 命令相比,autojump 能够更加快速地导航至目的目录。

|

||||

|

||||

#### autojump 的特色 ####

|

||||

|

||||

- 免费且开源的应用,在 GPL V3 协议下发布。

|

||||

- 自主学习的应用,从用户的浏览习惯中学习。

|

||||

- 更快速地浏览。不必包含子目录的名称。

|

||||

- 对于大多数的标准 Linux 发行版本,能够在软件仓库中下载得到,它们包括 Debian (testing/unstable), Ubuntu, Mint, Arch, Gentoo, Slackware, CentOS, RedHat and Fedora。

|

||||

- 自由开源的应用,在 GPL V3 协议下发布。

|

||||

- 自主学习的应用,从用户的导航习惯中学习。

|

||||

- 更快速地导航。不必包含子目录的名称。

|

||||

- 对于大多数的标准 Linux 发行版本,能够在软件仓库中下载得到,它们包括 Debian (testing/unstable), Ubuntu, Mint, Arch, Gentoo, Slackware, CentOS, RedHat 和 Fedora。

|

||||

- 也能在其他平台中使用,例如 OS X(使用 Homebrew) 和 Windows (通过 Clink 来实现)

|

||||

- 使用 autojump 你可以跳至任何特定的目录或一个子目录。你还可以打开文件管理器来到达某个目录,并查看你在某个目录中所待时间的统计数据。

|

||||

- 使用 autojump 你可以跳至任何特定的目录或一个子目录。你还可以用文件管理器打开某个目录,并查看你在某个目录中所待时间的统计数据。

|

||||

|

||||

#### 前提 ####

|

||||

|

||||

- 版本号不低于 2.6 的 Python

|

||||

|

||||

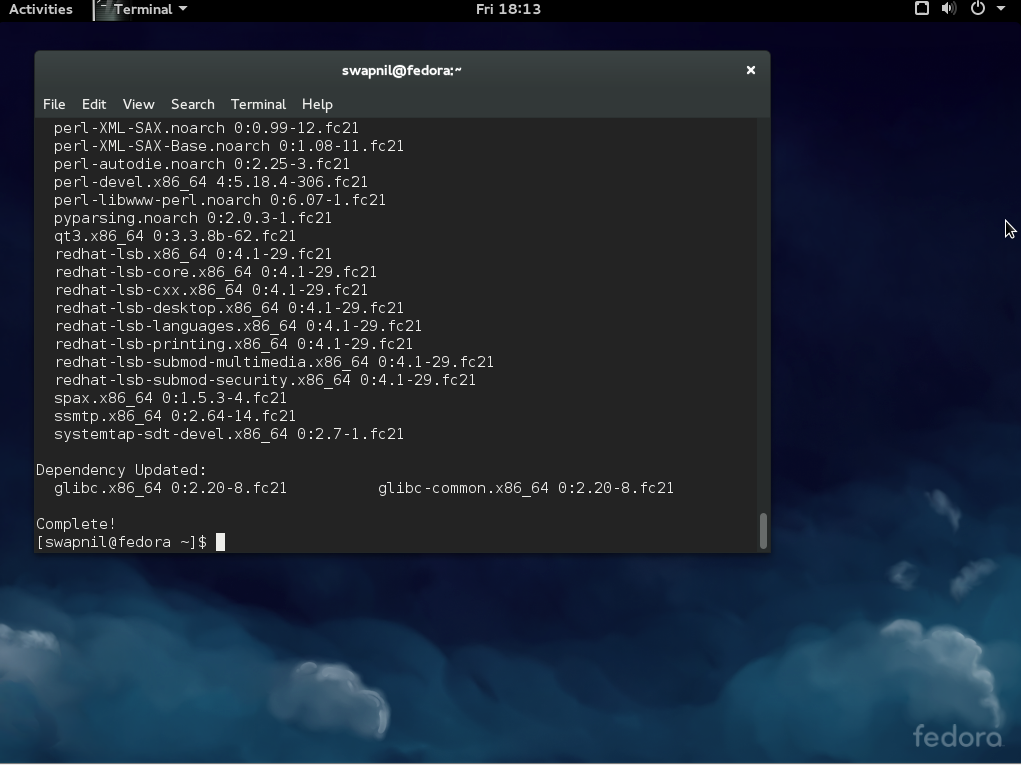

### 第 1 步: 做一次全局系统升级 ###

|

||||

### 第 1 步: 做一次完整的系统升级 ###

|

||||

|

||||

1. 以 **root** 用户的身份,做一次系统更新或升级,以此保证你安装有最新版本的 Python。

|

||||

1、 以 **root** 用户的身份,做一次系统更新或升级,以此保证你安装有最新版本的 Python。

|

||||

|

||||

# apt-get update && apt-get upgrade && apt-get dist-upgrade [APT based systems]

|

||||

# yum update && yum upgrade [YUM based systems]

|

||||

# dnf update && dnf upgrade [DNF based systems]

|

||||

# apt-get update && apt-get upgrade && apt-get dist-upgrade [基于 APT 的系统]

|

||||

# yum update && yum upgrade [基于 YUM 的系统]

|

||||

# dnf update && dnf upgrade [基于 DNF 的系统]

|

||||

|

||||

**注** : 这里特别提醒,在基于 YUM 或 DNF 的系统中,更新和升级执行相同的行动,大多数时间里它们是通用的,这点与基于 APT 的系统不同。

|

||||

|

||||

### 第 2 步: 下载和安装 Autojump ###

|

||||

|

||||

2. 正如前面所言,在大多数的 Linux 发行版本的软件仓库中, autojump 都可获取到。通过包管理器你就可以安装它。但若你想从源代码开始来安装它,你需要克隆源代码并执行 python 脚本,如下面所示:

|

||||

2、 正如前面所言,在大多数的 Linux 发行版本的软件仓库中, autojump 都可获取到。通过包管理器你就可以安装它。但若你想从源代码开始来安装它,你需要克隆源代码并执行 python 脚本,如下面所示:

|

||||

|

||||

#### 从源代码安装 ####

|

||||

|

||||

若没有安装 git,请安装它。我们需要使用它来克隆 git 仓库。

|

||||

|

||||

# apt-get install git [APT based systems]

|

||||

# yum install git [YUM based systems]

|

||||

# dnf install git [DNF based systems]

|

||||

# apt-get install git [基于 APT 的系统]

|

||||

# yum install git [基于 YUM 的系统]

|

||||

# dnf install git [基于 DNF 的系统]

|

||||

|

||||

一旦安装完 git,以常规用户身份登录,然后像下面那样来克隆 autojump:

|

||||

一旦安装完 git,以普通用户身份登录,然后像下面那样来克隆 autojump:

|

||||

|

||||

$ git clone git://github.com/joelthelion/autojump.git

|

||||

|

||||

@ -55,29 +56,29 @@ Autojump 应用从用户那里学习并帮助用户在 Linux 命令行中进行

|

||||

|

||||

$ cd autojump

|

||||

|

||||

下载,赋予脚本文件可执行权限,并以 root 用户身份来运行安装脚本。

|

||||

下载,赋予安装脚本文件可执行权限,并以 root 用户身份来运行安装脚本。

|

||||

|

||||

# chmod 755 install.py

|

||||

# ./install.py

|

||||

|

||||

#### 从软件仓库中安装 ####

|

||||

|

||||

3. 假如你不想麻烦,你可以以 **root** 用户身份从软件仓库中直接安装它:

|

||||

3、 假如你不想麻烦,你可以以 **root** 用户身份从软件仓库中直接安装它:

|

||||

|

||||

在 Debian, Ubuntu, Mint 及类似系统中安装 autojump :

|

||||

|

||||

# apt-get install autojump (注: 这里原文为 autojumo, 应该为 autojump)

|

||||

# apt-get install autojump

|

||||

|

||||

为了在 Fedora, CentOS, RedHat 及类似系统中安装 autojump, 你需要启用 [EPEL 软件仓库][2]。

|

||||

|

||||

# yum install epel-release

|

||||

# yum install autojump

|

||||

OR

|

||||

或

|

||||

# dnf install autojump

|

||||

|

||||

### 第 3 步: 安装后的配置 ###

|

||||

|

||||

4. 在 Debian 及其衍生系统 (Ubuntu, Mint,…) 中, 激活 autojump 应用是非常重要的。

|

||||

4、 在 Debian 及其衍生系统 (Ubuntu, Mint,…) 中, 激活 autojump 应用是非常重要的。

|

||||

|

||||

为了暂时激活 autojump 应用,即直到你关闭当前会话或打开一个新的会话之前让 autojump 均有效,你需要以常规用户身份运行下面的命令:

|

||||

|

||||

@ -89,7 +90,7 @@ Autojump 应用从用户那里学习并帮助用户在 Linux 命令行中进行

|

||||

|

||||

### 第 4 步: Autojump 的预测试和使用 ###

|

||||

|

||||

5. 如先前所言, autojump 将只跳到先前 `cd` 命令到过的目录。所以在我们开始测试之前,我们要使用 `cd` 切换到一些目录中去,并创建一些目录。下面是我所执行的命令。

|

||||

5、 如先前所言, autojump 将只跳到先前 `cd` 命令到过的目录。所以在我们开始测试之前,我们要使用 `cd` 切换到一些目录中去,并创建一些目录。下面是我所执行的命令。

|

||||

|

||||

$ cd

|

||||

$ cd

|

||||

@ -120,45 +121,45 @@ Autojump 应用从用户那里学习并帮助用户在 Linux 命令行中进行

|

||||

|

||||

现在,我们已经切换到过上面所列的目录,并为了测试创建了一些目录,一切准备就绪,让我们开始吧。

|

||||

|

||||

**需要记住的一点** : `j` 是 autojump 的一个包装,你可以使用 j 来代替 autojump, 相反亦可。

|

||||

**需要记住的一点** : `j` 是 autojump 的一个封装,你可以使用 j 来代替 autojump, 相反亦可。

|

||||

|

||||

6. 使用 -v 选项查看安装的 autojump 的版本。

|

||||

6、 使用 -v 选项查看安装的 autojump 的版本。

|

||||

|

||||

$ j -v

|

||||

or

|

||||

或

|

||||

$ autojump -v

|

||||

|

||||

|

||||

|

||||

查看 Autojump 的版本

|

||||

*查看 Autojump 的版本*

|

||||

|

||||

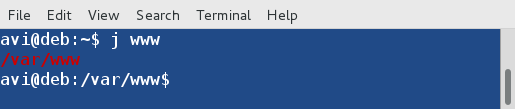

7. 跳到先前到过的目录 ‘/var/www‘。

|

||||

7、 跳到先前到过的目录 ‘/var/www‘。

|

||||

|

||||

$ j www

|

||||

|

||||

|

||||

|

||||

跳到目录

|

||||

*跳到目录*

|

||||

|

||||

8. 跳到先前到过的子目录‘/home/avi/autojump-test/b‘ 而不键入子目录的全名。

|

||||

8、 跳到先前到过的子目录‘/home/avi/autojump-test/b‘ 而不键入子目录的全名。

|

||||

|

||||

$ jc b

|

||||

|

||||

|

||||

|

||||

跳到子目录

|

||||

*跳到子目录*

|

||||

|

||||

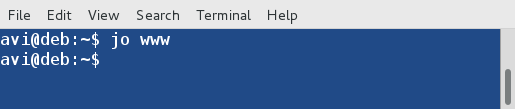

9. 使用下面的命令,你就可以从命令行打开一个文件管理器,例如 GNOME Nautilus ,而不是跳到一个目录。

|

||||

9、 使用下面的命令,你就可以从命令行打开一个文件管理器,例如 GNOME Nautilus ,而不是跳到一个目录。

|

||||

|

||||

$ jo www

|

||||

|

||||

|

||||

|

||||

|

||||

跳到目录

|

||||

*打开目录*

|

||||

|

||||

|

||||

|

||||

在文件管理器中打开目录

|

||||

*在文件管理器中打开目录*

|

||||

|

||||

你也可以在一个文件管理器中打开一个子目录。

|

||||

|

||||

@ -166,19 +167,19 @@ Autojump 应用从用户那里学习并帮助用户在 Linux 命令行中进行

|

||||

|

||||

|

||||

|

||||

打开子目录

|

||||

*打开子目录*

|

||||

|

||||

|

||||

|

||||

在文件管理器中打开子目录

|

||||

*在文件管理器中打开子目录*

|

||||

|

||||

10. 查看每个文件夹的关键权重和在所有目录权重中的总关键权重的相关统计数据。文件夹的关键权重代表在这个文件夹中所花的总时间。 目录权重是列表中目录的数目。(注: 在这一句中,我觉得原文中的 if 应该为 is)

|

||||

10、 查看每个文件夹的权重和全部文件夹计算得出的总权重的统计数据。文件夹的权重代表在这个文件夹中所花的总时间。 文件夹权重是该列表中目录的数字。(LCTT 译注: 在这一句中,我觉得原文中的 if 应该为 is)

|

||||

|

||||

$ j --stat

|

||||

|

||||

|

||||

|

||||

|

||||

查看目录统计数据

|

||||

*查看文件夹统计数据*

|

||||

|

||||

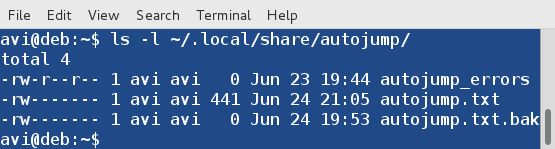

**提醒** : autojump 存储其运行日志和错误日志的地方是文件夹 `~/.local/share/autojump/`。千万不要重写这些文件,否则你将失去你所有的统计状态结果。

|

||||

|

||||

@ -186,15 +187,15 @@ Autojump 应用从用户那里学习并帮助用户在 Linux 命令行中进行

|

||||

|

||||

|

||||

|

||||

Autojump 的日志

|

||||

*Autojump 的日志*

|

||||

|

||||

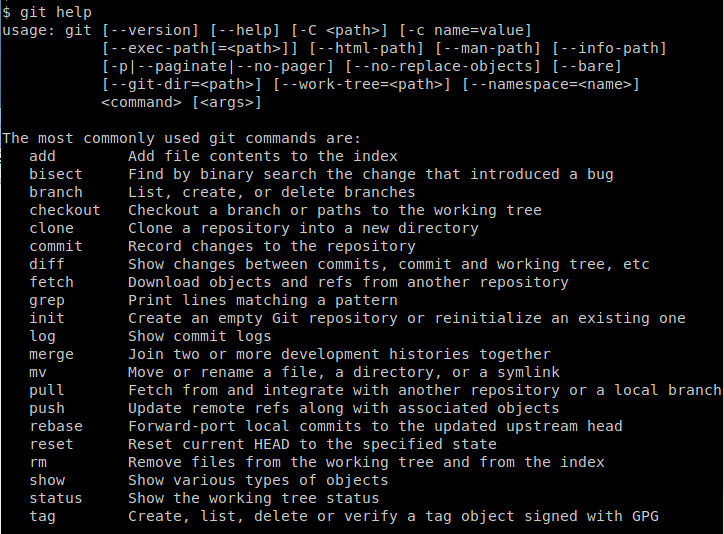

11. 假如需要,你只需运行下面的命令就可以查看帮助 :

|

||||

11、 假如需要,你只需运行下面的命令就可以查看帮助 :

|

||||

|

||||

$ j --help

|

||||

|

||||

|

||||

|

||||

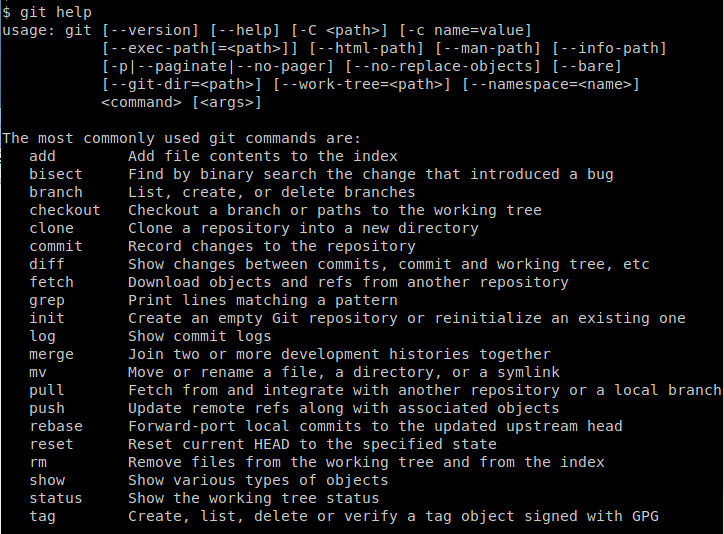

Autojump 的帮助和选项

|

||||

*Autojump 的帮助和选项*

|

||||

|

||||

### 功能需求和已知的冲突 ###

|

||||

|

||||

@ -204,18 +205,19 @@ Autojump 的帮助和选项

|

||||

|

||||

### 结论: ###

|

||||

|

||||

假如你是一个命令行用户, autojump 是你必备的实用程序。它可以简化许多事情。它是一个在命令行中浏览 Linux 目录的绝佳的程序。请自行尝试它,并在下面的评论框中让我知晓你宝贵的反馈。保持联系,保持分享。喜爱并分享,帮助我们更好地传播。

|

||||

假如你是一个命令行用户, autojump 是你必备的实用程序。它可以简化许多事情。它是一个在命令行中导航 Linux 目录的绝佳的程序。请自行尝试它,并在下面的评论框中让我知晓你宝贵的反馈。保持联系,保持分享。喜爱并分享,帮助我们更好地传播。

|

||||

|

||||

--------------------------------------------------------------------------------

|

||||

|

||||

via: http://www.tecmint.com/autojump-a-quickest-way-to-navigate-linux-filesystem/

|

||||

|

||||

作者:[Avishek Kumar][a]

|

||||

译者:[FSSlc](https://github.com/FSSlc)

|

||||

校对:[校对者ID](https://github.com/校对者ID)

|

||||

校对:[wxy](https://github.com/wxy)

|

||||

|

||||

本文由 [LCTT](https://github.com/LCTT/TranslateProject) 原创翻译,[Linux中国](https://linux.cn/) 荣誉推出

|

||||

|

||||

[a]:http://www.tecmint.com/author/avishek/

|

||||

[1]:http://www.tecmint.com/cd-command-in-linux/

|

||||

[2]:http://www.tecmint.com/how-to-enable-epel-repository-for-rhel-centos-6-5/

|

||||

[2]:https://linux.cn/article-2324-1.html

|

||||

[3]:http://www.tecmint.com/manage-linux-filenames-with-special-characters/

|

||||

@ -1,6 +1,6 @@

|

||||

如何在Ubuntu 14.04/15.04上配置Chef(服务端/客户端)

|

||||

如何在 Ubuntu 上安装配置管理系统 Chef (大厨)

|

||||

================================================================================

|

||||

Chef是对于信息技术专业人员的一款配置管理和自动化工具,它可以配置和管理你的设备无论它在本地还是在云上。它可以用于加速应用部署并协调多个系统管理员和开发人员的工作,涉及到成百甚至上千的服务器和程序来支持大量的客户群。chef最有用的是让设备变成代码。一旦你掌握了Chef,你可以获得一流的网络IT支持来自动化管理你的云端设备或者终端用户。

|

||||

Chef是面对IT专业人员的一款配置管理和自动化工具,它可以配置和管理你的基础设施,无论它在本地还是在云上。它可以用于加速应用部署并协调多个系统管理员和开发人员的工作,这涉及到可支持大量的客户群的成百上千的服务器和程序。chef最有用的是让基础设施变成代码。一旦你掌握了Chef,你可以获得一流的网络IT支持来自动化管理你的云端基础设施或者终端用户。

|

||||

|

||||

下面是我们将要在本篇中要设置和配置Chef的主要组件。

|

||||

|

||||

@ -10,34 +10,13 @@ Chef是对于信息技术专业人员的一款配置管理和自动化工具,

|

||||

|

||||

我们将在下面的基础环境下设置Chef配置管理系统。

|

||||

|

||||

注:表格

|

||||

<table width="701" style="height: 284px;">

|

||||

<tbody>

|

||||

<tr>

|

||||

<td width="660" colspan="2"><strong>管理和配置工具:Chef</strong></td>

|

||||

</tr>

|

||||

<tr>

|

||||

<td width="220"><strong>基础操作系统</strong></td>

|

||||

<td width="492">Ubuntu 14.04.1 LTS (x86_64)</td>

|

||||

</tr>

|

||||

<tr>

|

||||

<td width="220"><strong>Chef Server</strong></td>

|

||||

<td width="492">Version 12.1.0</td>

|

||||

</tr>

|

||||

<tr>

|

||||

<td width="220"><strong>Chef Manage</strong></td>

|

||||

<td width="492">Version 1.17.0</td>

|

||||

</tr>

|

||||

<tr>

|

||||

<td width="220"><strong>Chef Development Kit</strong></td>

|

||||

<td width="492">Version 0.6.2</td>

|

||||

</tr>

|

||||

<tr>

|

||||

<td width="220"><strong>内存和CPU</strong></td>

|

||||

<td width="492">4 GB , 2.0+2.0 GHZ</td>

|

||||

</tr>

|

||||

</tbody>

|

||||

</table>

|

||||

|管理和配置工具:Chef||

|

||||

|-------------------------------|---|

|

||||

|基础操作系统|Ubuntu 14.04.1 LTS (x86_64)|

|

||||

|Chef Server|Version 12.1.0|

|

||||

|Chef Manage|Version 1.17.0|

|

||||

|Chef Development Kit|Version 0.6.2|

|

||||

|内存和CPU|4 GB , 2.0+2.0 GHz|

|

||||

|

||||

### Chef服务端的安装和配置 ###

|

||||

|

||||

@ -45,15 +24,15 @@ Chef服务端是核心组件,它存储配置以及其他和工作站交互的

|

||||

|

||||

我使用下面的命令来下载和安装它。

|

||||

|

||||

**1) 下载Chef服务端**

|

||||

####1) 下载Chef服务端

|

||||

|

||||

root@ubuntu-14-chef:/tmp# wget https://web-dl.packagecloud.io/chef/stable/packages/ubuntu/trusty/chef-server-core_12.1.0-1_amd64.deb

|

||||

|

||||

**2) 安装Chef服务端**

|

||||

####2) 安装Chef服务端

|

||||

|

||||

root@ubuntu-14-chef:/tmp# dpkg -i chef-server-core_12.1.0-1_amd64.deb

|

||||

|

||||

**3) 重新配置Chef服务端**

|

||||

####3) 重新配置Chef服务端

|

||||

|

||||

现在运行下面的命令来启动所有的chef服务端服务,这步也许会花费一些时间,因为它有许多不同一起工作的服务组成来创建一个正常运作的系统。

|

||||

|

||||

@ -64,35 +43,35 @@ chef服务端启动命令'chef-server-ctl reconfigure'需要运行两次,这

|

||||

Chef Client finished, 342/350 resources updated in 113.71139964 seconds

|

||||

opscode Reconfigured!

|

||||

|

||||

**4) 重启系统 **

|

||||

####4) 重启系统

|

||||

|

||||

安装完成后重启系统使系统能最好的工作,不然我们或许会在创建用户的时候看到下面的SSL连接错误。

|

||||

|

||||

ERROR: Errno::ECONNRESET: Connection reset by peer - SSL_connect

|

||||

|

||||

**5) 创建心的管理员**

|

||||

####5) 创建新的管理员

|

||||

|

||||

运行下面的命令来创建一个新的用它自己的配置的管理员账户。创建过程中,用户的RSA私钥会自动生成并需要被保存到一个安全的地方。--file选项会保存RSA私钥到指定的路径下。

|

||||

运行下面的命令来创建一个新的管理员账户及其配置。创建过程中,用户的RSA私钥会自动生成,它需要保存到一个安全的地方。--file选项会保存RSA私钥到指定的路径下。

|

||||

|

||||

root@ubuntu-14-chef:/tmp# chef-server-ctl user-create kashi kashi kashi kashif.fareedi@gmail.com kashi123 --filename /root/kashi.pem

|

||||

|

||||

### Chef服务端的管理设置 ###

|

||||

|

||||

Chef Manage是一个针对企业Chef用户的管理控制台,它启用了可视化的web用户界面并可以管理节点、数据包、规则、环境、配置和基于角色的访问控制(RBAC)

|

||||

Chef Manage是一个针对企业Chef用户的管理控制台,它提供了可视化的web用户界面,可以管理节点、数据包、规则、环境、Cookbook 和基于角色的访问控制(RBAC)

|

||||

|

||||

**1) 下载Chef Manage**

|

||||

####1) 下载Chef Manage

|

||||

|

||||

从官网复制链接病下载chef manage的安装包。

|

||||

从官网复制链接并下载chef manage的安装包。

|

||||

|

||||

root@ubuntu-14-chef:~# wget https://web-dl.packagecloud.io/chef/stable/packages/ubuntu/trusty/opscode-manage_1.17.0-1_amd64.deb

|

||||

|

||||

**2) 安装Chef Manage**

|

||||

####2) 安装Chef Manage

|

||||

|

||||

使用下面的命令在root的家目录下安装它。

|

||||

|

||||

root@ubuntu-14-chef:~# chef-server-ctl install opscode-manage --path /root

|

||||

|

||||

**3) 重启Chef Manage和服务端**

|

||||

####3) 重启Chef Manage和服务端

|

||||

|

||||

安装完成后我们需要运行下面的命令来重启chef manage和服务端。

|

||||

|

||||

@ -101,28 +80,27 @@ Chef Manage是一个针对企业Chef用户的管理控制台,它启用了可

|

||||

|

||||

### Chef Manage网页控制台 ###

|

||||

|

||||

我们可以使用localhost访问网页控制台以及fqdn,并用已经创建的管理员登录

|

||||

我们可以使用localhost或它的全称域名来访问网页控制台,并用已经创建的管理员登录

|

||||

|

||||

|

||||

|

||||

**1) Chef Manage创建新的组织 **

|

||||

####1) Chef Manage创建新的组织

|

||||

|

||||

你或许被要求创建新的组织或者接受其他阻止的邀请。如下所示,使用缩写和全名来创建一个新的组织。

|

||||

你或许被要求创建新的组织,或者也可以接受其他组织的邀请。如下所示,使用缩写和全名来创建一个新的组织。

|

||||

|

||||

|

||||

|

||||

**2) 用命令行创建心的组织 **

|

||||

####2) 用命令行创建新的组织

|

||||

|

||||

We can also create new Organization from the command line by executing the following command.

|

||||

我们同样也可以运行下面的命令来创建新的组织。

|

||||

|

||||

root@ubuntu-14-chef:~# chef-server-ctl org-create linux Linoxide Linux Org. --association_user kashi --filename linux.pem

|

||||

|

||||

### 设置工作站 ###

|

||||

|

||||

我们已经完成安装chef服务端,现在我们可以开始创建任何recipes、cookbooks、属性和其他任何的我们想要对Chef的修改。

|

||||

我们已经完成安装chef服务端,现在我们可以开始创建任何recipes([基础配置元素](https://docs.chef.io/recipes.html))、cookbooks([基础配置集](https://docs.chef.io/cookbooks.html))、attributes([节点属性](https://docs.chef.io/attributes.html))和其他任何的我们想要对Chef做的修改。

|

||||

|

||||

**1) 在Chef服务端上创建新的用户和组织 **

|

||||

####1) 在Chef服务端上创建新的用户和组织

|

||||

|

||||

为了设置工作站,我们用命令行创建一个新的用户和组织。

|

||||

|

||||

@ -130,25 +108,23 @@ We can also create new Organization from the command line by executing the follo

|

||||

|

||||

root@ubuntu-14-chef:~# chef-server-ctl org-create blogs Linoxide Blogs Inc. --association_user bloger --filename blogs.pem

|

||||

|

||||

**2) 下载工作站入门套件 **

|

||||

####2) 下载工作站入门套件

|

||||

|

||||

Now Download and Save starter-kit from the chef manage web console on a workstation and use it to work with Chef server.

|

||||

在工作站的网页控制台中下面并保存入门套件用于与服务端协同工作

|

||||

在工作站的网页控制台中下载保存入门套件,它用于与服务端协同工作

|

||||

|

||||

|

||||

|

||||

**3) 点击"Proceed"下载套件 **

|

||||

####3) 下载套件后,点击"Proceed"

|

||||

|

||||

|

||||

|

||||

### 对于工作站的Chef开发套件设置 ###

|

||||

### 用于工作站的Chef开发套件设置 ###

|

||||

|

||||

Chef开发套件是一款包含所有开发chef所需工具的软件包。它捆绑了由Chef开发的带Chef客户端的工具。

|

||||

Chef开发套件是一款包含开发chef所需的所有工具的软件包。它捆绑了由Chef开发的带Chef客户端的工具。

|

||||

|

||||

**1) 下载 Chef DK**

|

||||

####1) 下载 Chef DK

|

||||

|

||||

We can Download chef development kit from its official web link and choose the required operating system to get its chef development tool kit.

|

||||

我们可以从它的官网链接中下载开发包,并选择操作系统来得到chef开发包。

|

||||

我们可以从它的官网链接中下载开发包,并选择操作系统来下载chef开发包。

|

||||

|

||||

|

||||

|

||||

@ -156,13 +132,13 @@ We can Download chef development kit from its official web link and choose the r

|

||||

|

||||

root@ubuntu-15-WKS:~# wget https://opscode-omnibus-packages.s3.amazonaws.com/ubuntu/12.04/x86_64/chefdk_0.6.2-1_amd64.deb

|

||||

|

||||

**1) Chef开发套件安装**

|

||||

####2) Chef开发套件安装

|

||||

|

||||

使用dpkg命令安装开发套件

|

||||

|

||||

root@ubuntu-15-WKS:~# dpkg -i chefdk_0.6.2-1_amd64.deb

|

||||

|

||||

**3) Chef DK 验证**

|

||||

####3) Chef DK 验证

|

||||

|

||||

使用下面的命令验证客户端是否已经正确安装。

|

||||

|

||||

@ -195,7 +171,7 @@ We can Download chef development kit from its official web link and choose the r

|

||||

Verification of component 'chefspec' succeeded.

|

||||

Verification of component 'package installation' succeeded.

|

||||

|

||||

**连接Chef服务端**

|

||||

####4) 连接Chef服务端

|

||||

|

||||

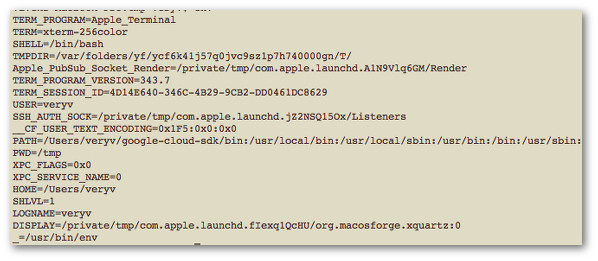

我们将创建 ~/.chef并从chef服务端复制两个用户和组织的pem文件到chef的文件到这个目录下。

|

||||

|

||||

@ -209,7 +185,7 @@ We can Download chef development kit from its official web link and choose the r

|

||||

kashi.pem 100% 1678 1.6KB/s 00:00

|

||||

linux.pem 100% 1678 1.6KB/s 00:00

|

||||

|

||||

** 编辑配置来管理chef环境 **

|

||||

####5) 编辑配置来管理chef环境

|

||||

|

||||

现在使用下面的内容创建"~/.chef/knife.rb"。

|

||||

|

||||

@ -231,13 +207,13 @@ We can Download chef development kit from its official web link and choose the r

|

||||

|

||||

root@ubuntu-15-WKS:/# mkdir cookbooks

|

||||

|

||||

**测试Knife配置**

|

||||

####6) 测试Knife配置

|

||||

|

||||

运行“knife user list”和“knife client list”来验证knife是否在工作。

|

||||

|

||||

root@ubuntu-15-WKS:/.chef# knife user list

|

||||

|

||||

第一次运行的时候可能会得到下面的错误,这是因为工作站上还没有chef服务端的SSL证书。

|

||||

第一次运行的时候可能会看到下面的错误,这是因为工作站上还没有chef服务端的SSL证书。

|

||||

|

||||

ERROR: SSL Validation failure connecting to host: 172.25.10.173 - SSL_connect returned=1 errno=0 state=SSLv3 read server certificate B: certificate verify failed

|

||||

ERROR: Could not establish a secure connection to the server.

|

||||

@ -245,24 +221,24 @@ We can Download chef development kit from its official web link and choose the r

|

||||

If your Chef Server uses a self-signed certificate, you can use

|

||||

`knife ssl fetch` to make knife trust the server's certificates.

|

||||

|

||||

要从上面的命令中恢复,运行下面的命令来获取ssl整数并重新运行knife user和client list,这时候应该就可以了。

|

||||

要从上面的命令中恢复,运行下面的命令来获取ssl证书,并重新运行knife user和client list,这时候应该就可以了。

|

||||

|

||||

root@ubuntu-15-WKS:/.chef# knife ssl fetch

|

||||

WARNING: Certificates from 172.25.10.173 will be fetched and placed in your trusted_cert

|

||||

directory (/.chef/trusted_certs).

|

||||

|

||||

knife没有办法验证这些是有效的证书。你应该在下载时候验证这些证书的真实性。

|

||||

knife没有办法验证这些是有效的证书。你应该在下载时候验证这些证书的真实性。

|

||||

|

||||

在/.chef/trusted_certs/ubuntu-14-chef_test_com.crt下面添加ubuntu-14-chef.test.com的证书。

|

||||

在/.chef/trusted_certs/ubuntu-14-chef_test_com.crt下面添加ubuntu-14-chef.test.com的证书。

|

||||

|

||||

在上面的命令取得ssl证书后,接着运行下面的命令。

|

||||

|

||||

root@ubuntu-15-WKS:/.chef#knife client list

|

||||

kashi-linux

|

||||

|

||||

### 与chef服务端交互的新的节点 ###

|

||||

### 配置与chef服务端交互的新节点 ###

|

||||

|

||||

节点是执行所有设备自动化的chef客户端。因此是时侯添加新的服务端到我们的chef环境下,在配置完chef-server和knife工作站后配置新的节点与chef-server交互。

|

||||

节点是执行所有基础设施自动化的chef客户端。因此,在配置完chef-server和knife工作站后,通过配置新的与chef-server交互的节点,来添加新的服务端到我们的chef环境下。

|

||||

|

||||

我们使用下面的命令来添加新的节点与chef服务端工作。

|

||||

|

||||

@ -291,16 +267,16 @@ We can Download chef development kit from its official web link and choose the r

|

||||

172.25.10.170 to file /tmp/install.sh.26024/metadata.txt

|

||||

172.25.10.170 trying wget...

|

||||

|

||||

之后我们可以在knife节点列表下看到新创建的节点,也会新节点列表下创建新的客户端。

|

||||

之后我们可以在knife节点列表下看到新创建的节点,它也会在新节点创建新的客户端。

|

||||

|

||||

root@ubuntu-15-WKS:~# knife node list

|

||||

mydns

|

||||

|

||||

相似地我们只要提供ssh证书通过上面的knife命令来创建多个节点到chef设备上。

|

||||

相似地我们只要提供ssh证书通过上面的knife命令,就可以在chef设施上创建多个节点。

|

||||

|

||||

### 总结 ###

|

||||

|

||||

本篇我们学习了chef管理工具并通过安装和配置设置浏览了它的组件。我希望你在学习安装和配置Chef服务端以及它的工作站和客户端节点中获得乐趣。

|

||||

本篇我们学习了chef管理工具并通过安装和配置设置基本了解了它的组件。我希望你在学习安装和配置Chef服务端以及它的工作站和客户端节点中获得乐趣。

|

||||

|

||||

--------------------------------------------------------------------------------

|

||||

|

||||

@ -308,7 +284,7 @@ via: http://linoxide.com/ubuntu-how-to/install-configure-chef-ubuntu-14-04-15-04

|

||||

|

||||

作者:[Kashif Siddique][a]

|

||||

译者:[geekpi](https://github.com/geekpi)

|

||||

校对:[校对者ID](https://github.com/校对者ID)

|

||||

校对:[wxy](https://github.com/wxy)

|

||||

|

||||

本文由 [LCTT](https://github.com/LCTT/TranslateProject) 原创翻译,[Linux中国](https://linux.cn/) 荣誉推出

|

||||

|

||||

178

published/20150717 How to collect NGINX metrics - Part 2.md

Normal file

178

published/20150717 How to collect NGINX metrics - Part 2.md

Normal file

@ -0,0 +1,178 @@

|

||||

|

||||

如何收集 NGINX 指标(第二篇)

|

||||

================================================================================

|

||||

|

||||

|

||||

### 如何获取你所需要的 NGINX 指标 ###

|

||||

|

||||

如何获取需要的指标取决于你正在使用的 NGINX 版本以及你希望看到哪些指标。(参见 [如何监控 NGINX(第一篇)][1] 来深入了解NGINX指标。)自由开源的 NGINX 和商业版的 NGINX Plus 都有可以报告指标度量的状态模块,NGINX 也可以在其日志中配置输出特定指标:

|

||||

|

||||

**指标可用性**

|

||||

|

||||

| 指标 | [NGINX (开源)](https://www.datadoghq.com/blog/how-to-collect-nginx-metrics/#open-source) | [NGINX Plus](https://www.datadoghq.com/blog/how-to-collect-nginx-metrics/#plus) | [NGINX 日志](https://www.datadoghq.com/blog/how-to-collect-nginx-metrics/#logs)|

|

||||

|-----|------|-------|-----|

|

||||

|accepts(接受) / accepted(已接受)|x|x| |

|

||||

|handled(已处理)|x|x| |

|

||||

|dropped(已丢弃)|x|x| |

|

||||

|active(活跃)|x|x| |

|

||||

|requests (请求数)/ total(全部请求数)|x|x| |

|

||||

|4xx 代码||x|x|

|

||||

|5xx 代码||x|x|

|

||||

|request time(请求处理时间)|||x|

|

||||

|

||||

#### 指标收集:NGINX(开源版) ####

|

||||

|

||||

开源版的 NGINX 会在一个简单的状态页面上显示几个与服务器状态有关的基本指标,它们由你启用的 HTTP [stub status module][2] 所提供。要检查该模块是否已启用,运行以下命令:

|

||||

|

||||

nginx -V 2>&1 | grep -o with-http_stub_status_module

|

||||

|

||||

如果你看到终端输出了 **http_stub_status_module**,说明该状态模块已启用。

|

||||

|

||||

如果该命令没有输出,你需要启用该状态模块。你可以在[从源代码构建 NGINX ][3]时使用 `--with-http_stub_status_module` 配置参数:

|

||||

|

||||

./configure \

|

||||

… \

|

||||

--with-http_stub_status_module

|

||||

make

|

||||

sudo make install

|

||||

|

||||

在验证该模块已经启用或你自己启用它后,你还需要修改 NGINX 配置文件,来给状态页面设置一个本地可访问的 URL(例如: /nginx_status):

|

||||

|

||||

server {

|

||||

location /nginx_status {

|

||||

stub_status on;

|

||||

|

||||

access_log off;

|

||||

allow 127.0.0.1;

|

||||

deny all;

|

||||

}

|

||||

}

|

||||

|

||||

注:nginx 配置中的 server 块通常并不放在主配置文件中(例如:/etc/nginx/nginx.conf),而是放在主配置会加载的辅助配置文件中。要找到主配置文件,首先运行以下命令:

|

||||

|

||||

nginx -t

|

||||

|

||||

打开列出的主配置文件,在以 http 块结尾的附近查找以 include 开头的行,如:

|

||||

|

||||

include /etc/nginx/conf.d/*.conf;

|

||||

|

||||

在其中一个包含的配置文件中,你应该会找到主 **server** 块,你可以如上所示配置 NGINX 的指标输出。更改任何配置后,通过执行以下命令重新加载配置文件:

|

||||

|

||||

nginx -s reload

|

||||

|

||||

现在,你可以浏览状态页看到你的指标:

|

||||

|

||||

Active connections: 24

|

||||

server accepts handled requests

|

||||

1156958 1156958 4491319

|

||||

Reading: 0 Writing: 18 Waiting : 6

|

||||

|

||||

请注意,如果你希望从远程计算机访问该状态页面,则需要将远程计算机的 IP 地址添加到你的状态配置文件的白名单中,在上面的配置文件中的白名单仅有 127.0.0.1。

|

||||

|

||||

NGINX 的状态页面是一种快速查看指标状况的简单方法,但当连续监测时,你需要按照标准间隔自动记录该数据。监控工具箱 [Nagios][4] 或者 [Datadog][5],以及收集统计信息的服务 [collectD][6] 已经可以解析 NGINX 的状态信息了。

|

||||

|

||||

#### 指标收集: NGINX Plus ####

|

||||

|

||||

商业版的 NGINX Plus 通过它的 ngx_http_status_module 提供了比开源版 NGINX [更多的指标][7]。NGINX Plus 以字节流的方式提供这些额外的指标,提供了关于上游系统和高速缓存的信息。NGINX Plus 也会报告所有的 HTTP 状态码类型(1XX,2XX,3XX,4XX,5XX)的计数。一个 NGINX Plus 状态报告例子[可在此查看][8]:

|

||||

|

||||

|

||||

|

||||

注:NGINX Plus 在状态仪表盘中的“Active”连接的定义和开源 NGINX 通过 stub_status_module 收集的“Active”连接指标略有不同。在 NGINX Plus 指标中,“Active”连接不包括Waiting状态的连接(即“Idle”连接)。

|

||||

|

||||

NGINX Plus 也可以输出 [JSON 格式的指标][9],可以用于集成到其他监控系统。在 NGINX Plus 中,你可以看到 [给定的上游服务器组][10]的指标和健康状况,或者简单地从上游服务器的[单个服务器][11]得到响应代码的计数:

|

||||

|

||||

{"1xx":0,"2xx":3483032,"3xx":0,"4xx":23,"5xx":0,"total":3483055}

|

||||

|

||||

要启动 NGINX Plus 指标仪表盘,你可以在 NGINX 配置文件的 http 块内添加状态 server 块。 (参见上一节,为收集开源版 NGINX 指标而如何查找相关的配置文件的说明。)例如,要设置一个状态仪表盘 (http://your.ip.address:8080/status.html)和一个 JSON 接口(http://your.ip.address:8080/status),可以添加以下 server 块来设定:

|

||||

|

||||

server {

|

||||

listen 8080;

|

||||

root /usr/share/nginx/html;

|

||||

|

||||

location /status {

|

||||

status;

|

||||

}

|

||||

|

||||

location = /status.html {

|

||||

}

|

||||

}

|

||||

|

||||

当你重新加载 NGINX 配置后,状态页就可以用了:

|

||||

|

||||

nginx -s reload

|

||||

|

||||

关于如何配置扩展状态模块,官方 NGINX Plus 文档有 [详细介绍][13] 。

|

||||

|

||||

#### 指标收集:NGINX 日志 ####

|

||||

|

||||

NGINX 的 [日志模块][14] 会把可自定义的访问日志写到你配置的指定位置。你可以通过[添加或移除变量][15]来自定义日志的格式和包含的数据。要存储详细的日志,最简单的方法是添加下面一行在你配置文件的 server 块中(参见上上节,为收集开源版 NGINX 指标而如何查找相关的配置文件的说明。):

|

||||

|

||||

access_log logs/host.access.log combined;

|

||||

|

||||

更改 NGINX 配置文件后,执行如下命令重新加载配置文件:

|

||||

|

||||

nginx -s reload

|

||||

|

||||

默认包含的 “combined” 的日志格式,会包括[一系列关键的数据][17],如实际的 HTTP 请求和相应的响应代码。在下面的示例日志中,NGINX 记录了请求 /index.html 时的 200(成功)状态码和访问不存在的请求文件 /fail 的 404(未找到)错误。

|

||||

|

||||

127.0.0.1 - - [19/Feb/2015:12:10:46 -0500] "GET /index.html HTTP/1.1" 200 612 "-" "Mozilla/5.0 (Macintosh; Intel Mac OS X 10_10_1) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/40.0.2214.111 Safari 537.36"

|

||||

|

||||

127.0.0.1 - - [19/Feb/2015:12:11:05 -0500] "GET /fail HTTP/1.1" 404 570 "-" "Mozilla/5.0 (Macintosh; Intel Mac OS X 10_10_1) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/40.0.2214.111 Safari/537.36"

|

||||

|

||||

你可以通过在 NGINX 配置文件中的 http 块添加一个新的日志格式来记录请求处理时间:

|

||||

|

||||

log_format nginx '$remote_addr - $remote_user [$time_local] '

|

||||

'"$request" $status $body_bytes_sent $request_time '

|

||||

'"$http_referer" "$http_user_agent"';

|

||||

|

||||

并修改配置文件中 **server** 块的 access_log 行:

|

||||

|

||||

access_log logs/host.access.log nginx;

|

||||

|

||||

重新加载配置文件后(运行 `nginx -s reload`),你的访问日志将包括响应时间,如下所示。单位为秒,精度到毫秒。在这个例子中,服务器接收到一个对 /big.pdf 的请求时,发送 33973115 字节后返回 206(成功)状态码。处理请求用时 0.202 秒(202毫秒):

|

||||

|

||||

127.0.0.1 - - [19/Feb/2015:15:50:36 -0500] "GET /big.pdf HTTP/1.1" 206 33973115 0.202 "-" "Mozilla/5.0 (Macintosh; Intel Mac OS X 10_10_1) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/40.0.2214.111 Safari/537.36"

|

||||

|

||||

你可以使用各种工具和服务来解析和分析 NGINX 日志。例如,[rsyslog][18] 可以监视你的日志,并将其传递给多个日志分析服务;你也可以使用自由开源工具,比如 [logstash][19] 来收集和分析日志;或者你可以使用一个统一日志记录层,如 [Fluentd][20] 来收集和解析你的 NGINX 日志。

|

||||

|

||||

### 结论 ###

|

||||

|

||||

监视 NGINX 的哪一项指标将取决于你可用的工具,以及监控指标所提供的信息是否满足你们的需要。举例来说,错误率的收集是否足够重要到需要你们购买 NGINX Plus ,还是架设一个可以捕获和分析日志的系统就够了?

|

||||

|

||||

在 Datadog 中,我们已经集成了 NGINX 和 NGINX Plus,这样你就可以以最小的设置来收集和监控所有 Web 服务器的指标。[在本文中][21]了解如何用 NGINX Datadog 来监控 ,并开始 [Datadog 的免费试用][22]吧。

|

||||

|

||||

|

||||

--------------------------------------------------------------------------------

|

||||

|

||||

via: https://www.datadoghq.com/blog/how-to-collect-nginx-metrics/

|

||||

|

||||

作者:K Young

|

||||

译者:[strugglingyouth](https://github.com/strugglingyouth)

|

||||

校对:[wxy](https://github.com/wxy)

|

||||

|

||||

本文由 [LCTT](https://github.com/LCTT/TranslateProject) 原创翻译,[Linux中国](https://linux.cn/) 荣誉推出

|

||||

|

||||

[1]:https://www.datadoghq.com/blog/how-to-monitor-nginx/

|

||||

[2]:http://nginx.org/en/docs/http/ngx_http_stub_status_module.html

|

||||

[3]:http://wiki.nginx.org/InstallOptions

|

||||

[4]:https://exchange.nagios.org/directory/Plugins/Web-Servers/nginx

|

||||

[5]:http://docs.datadoghq.com/integrations/nginx/

|

||||

[6]:https://collectd.org/wiki/index.php/Plugin:nginx

|

||||

[7]:http://nginx.org/en/docs/http/ngx_http_status_module.html#data

|

||||

[8]:http://demo.nginx.com/status.html

|

||||

[9]:http://demo.nginx.com/status

|

||||

[10]:http://demo.nginx.com/status/upstreams/demoupstreams

|

||||

[11]:http://demo.nginx.com/status/upstreams/demoupstreams/0/responses

|

||||

[12]:https://www.datadoghq.com/blog/how-to-collect-nginx-metrics/#open-source

|

||||

[13]:http://nginx.org/en/docs/http/ngx_http_status_module.html#example

|

||||

[14]:http://nginx.org/en/docs/http/ngx_http_log_module.html

|

||||

[15]:http://nginx.org/en/docs/http/ngx_http_log_module.html#log_format

|

||||

[16]:https://www.datadoghq.com/blog/how-to-collect-nginx-metrics/#open-source

|

||||

[17]:http://nginx.org/en/docs/http/ngx_http_log_module.html#log_format

|

||||

[18]:http://www.rsyslog.com/

|

||||

[19]:https://www.elastic.co/products/logstash

|

||||

[20]:http://www.fluentd.org/

|

||||

[21]:https://www.datadoghq.com/blog/how-to-monitor-nginx-with-datadog/

|

||||

[22]:https://www.datadoghq.com/blog/how-to-collect-nginx-metrics/#sign-up

|

||||

[23]:https://github.com/DataDog/the-monitor/blob/master/nginx/how_to_collect_nginx_metrics.md

|

||||

[24]:https://github.com/DataDog/the-monitor/issues

|

||||

231

published/20150717 How to monitor NGINX- Part 1.md

Normal file

231

published/20150717 How to monitor NGINX- Part 1.md

Normal file

@ -0,0 +1,231 @@

|

||||

如何监控 NGINX(第一篇)

|

||||

================================================================================

|

||||

|

||||

|

||||

### NGINX 是什么? ###

|

||||

|

||||

[NGINX][1] (发音为 “engine X”) 是一种流行的 HTTP 和反向代理服务器。作为一个 HTTP 服务器,NGINX 可以使用较少的内存非常高效可靠地提供静态内容。作为[反向代理][2],它可以用作多个后端服务器或类似缓存和负载平衡这样的其它应用的单一访问控制点。NGINX 是一个自由开源的产品,并有一个具备更全的功能的叫做 NGINX Plus 的商业版。

|

||||

|

||||

NGINX 也可以用作邮件代理和通用的 TCP 代理,但本文并不直接讨论 NGINX 的那些用例的监控。

|

||||

|

||||

### NGINX 主要指标 ###

|

||||

|

||||

通过监控 NGINX 可以 捕获到两类问题:NGINX 本身的资源问题,和出现在你的基础网络设施的其它问题。大多数 NGINX 用户会用到以下指标的监控,包括**每秒请求数**,它提供了一个由所有最终用户活动组成的上层视图;**服务器错误率** ,这表明你的服务器已经多长没有处理看似有效的请求;还有**请求处理时间**,这说明你的服务器处理客户端请求的总共时长(并且可以看出性能降低或当前环境的其他问题)。

|

||||

|

||||

更一般地,至少有三个主要的指标类别来监视:

|

||||

|

||||

- 基本活动指标

|

||||

- 错误指标

|

||||

- 性能指标

|

||||

|

||||

下面我们将分析在每个类别中最重要的 NGINX 指标,以及用一个相当普遍但是值得特别提到的案例来说明:使用 NGINX Plus 作反向代理。我们还将介绍如何使用图形工具或可选择的监控工具来监控所有的指标。

|

||||

|

||||

本文引用指标术语[来自我们的“监控 101 系列”][3],,它提供了一个指标收集和警告框架。

|

||||

|

||||

#### 基本活跃指标 ####

|

||||

|

||||

无论你在怎样的情况下使用 NGINX,毫无疑问你要监视服务器接收多少客户端请求和如何处理这些请求。

|

||||

|

||||

NGINX Plus 上像开源 NGINX 一样可以报告基本活跃指标,但它也提供了略有不同的辅助模块。我们首先讨论开源的 NGINX,再来说明 NGINX Plus 提供的其他指标的功能。

|

||||

|

||||

**NGINX**

|

||||

|

||||

下图显示了一个客户端连接的过程,以及开源版本的 NGINX 如何在连接过程中收集指标。

|

||||

|

||||

|

||||

|

||||

Accepts(接受)、Handled(已处理)、Requests(请求)是一直在增加的计数器。Active(活跃)、Waiting(等待)、Reading(读)、Writing(写)随着请求量而增减。

|

||||

|

||||

| 名称 | 描述| [指标类型](https://www.datadoghq.com/blog/monitoring-101-collecting-data/)|

|

||||

|-----------|-----------------|-------------------------------------------------------------------------------------------------------------------------|

|

||||

| Accepts | NGINX 所接受的客户端连接数 | 资源: 功能 |

|

||||

| Handled | 成功的客户端连接数 | 资源: 功能 |

|

||||

| Active | 当前活跃的客户端连接数| 资源: 功能 |

|

||||

| Dropped(已丢弃,计算得出)| 丢弃的连接数(接受 - 已处理)| 工作:错误*|

|

||||

| Requests | 客户端请求数 | 工作:吞吐量 |

|

||||

|

||||

|

||||

_*严格的来说,丢弃的连接是 [一个资源饱和指标](https://www.datadoghq.com/blog/monitoring-101-collecting-data/#resource-metrics),但是因为饱和会导致 NGINX 停止服务(而不是延后该请求),所以,“已丢弃”视作 [一个工作指标](https://www.datadoghq.com/blog/monitoring-101-collecting-data/#work-metrics) 比较合适。_

|

||||

|

||||

NGINX worker 进程接受 OS 的连接请求时 **Accepts** 计数器增加,而**Handled** 是当实际的请求得到连接时(通过建立一个新的连接或重新使用一个空闲的)。这两个计数器的值通常都是相同的,如果它们有差别则表明连接被**Dropped**,往往这是由于资源限制,比如已经达到 NGINX 的[worker_connections][4]的限制。

|

||||

|

||||

一旦 NGINX 成功处理一个连接时,连接会移动到**Active**状态,在这里对客户端请求进行处理:

|

||||

|

||||

Active状态

|

||||

|

||||

- **Waiting**: 活跃的连接也可以处于 Waiting 子状态,如果有在此刻没有活跃请求的话。新连接可以绕过这个状态并直接变为到 Reading 状态,最常见的是在使用“accept filter(接受过滤器)” 和 “deferred accept(延迟接受)”时,在这种情况下,NGINX 不会接收 worker 进程的通知,直到它具有足够的数据才开始响应。如果连接设置为 keep-alive ,那么它在发送响应后将处于等待状态。

|

||||

|

||||

- **Reading**: 当接收到请求时,连接离开 Waiting 状态,并且该请求本身使 Reading 状态计数增加。在这种状态下 NGINX 会读取客户端请求首部。请求首部是比较小的,因此这通常是一个快速的操作。

|

||||

|

||||

- **Writing**: 请求被读取之后,其使 Writing 状态计数增加,并保持在该状态,直到响应返回给客户端。这意味着,该请求在 Writing 状态时, 一方面 NGINX 等待来自上游系统的结果(系统放在 NGINX “后面”),另外一方面,NGINX 也在同时响应。请求往往会在 Writing 状态花费大量的时间。

|

||||

|

||||

通常,一个连接在同一时间只接受一个请求。在这种情况下,Active 连接的数目 == Waiting 的连接 + Reading 请求 + Writing 。然而,较新的 SPDY 和 HTTP/2 协议允许多个并发请求/响应复用一个连接,所以 Active 可小于 Waiting 的连接、 Reading 请求、Writing 请求的总和。 (在撰写本文时,NGINX 不支持 HTTP/2,但预计到2015年期间将会支持。)

|

||||

|

||||

**NGINX Plus**

|

||||

|

||||

正如上面提到的,所有开源 NGINX 的指标在 NGINX Plus 中是可用的,但另外也提供其他的指标。本节仅说明了 NGINX Plus 可用的指标。

|

||||

|

||||

|

||||

|

||||

|

||||

Accepted (已接受)、Dropped,总数是不断增加的计数器。Active、 Idle(空闲)和处于 Current(当前)处理阶段的各种状态下的连接或请求的当前数量随着请求量而增减。

|

||||

|

||||

| 名称 | 描述| [指标类型](https://www.datadoghq.com/blog/monitoring-101-collecting-data/)|

|

||||

|-----------|-----------------|-------------------------------------------------------------------------------------------------------------------------|

|

||||

| Accepted | NGINX 所接受的客户端连接数 | 资源: 功能 |

|

||||

| Dropped |丢弃的连接数(接受 - 已处理)| 工作:错误*|

|

||||

| Active | 当前活跃的客户端连接数| 资源: 功能 |

|

||||

| Idle | 没有当前请求的客户端连接| 资源: 功能 |

|

||||

| Total(全部) | 客户端请求数 | 工作:吞吐量 |

|

||||

|

||||

_*严格的来说,丢弃的连接是 [一个资源饱和指标](https://www.datadoghq.com/blog/monitoring-101-collecting-data/#resource-metrics),但是因为饱和会导致 NGINX 停止服务(而不是延后该请求),所以,“已丢弃”视作 [一个工作指标](https://www.datadoghq.com/blog/monitoring-101-collecting-data/#work-metrics) 比较合适。_

|

||||

|

||||

当 NGINX Plus worker 进程接受 OS 的连接请求时 **Accepted** 计数器递增。如果 worker 进程为请求建立连接失败(通过建立一个新的连接或重新使用一个空闲),则该连接被丢弃, **Dropped** 计数增加。通常连接被丢弃是因为资源限制,如 NGINX Plus 的[worker_connections][4]的限制已经达到。

|

||||

|

||||

**Active** 和 **Idle** 和[如上所述][5]的开源 NGINX 的“active” 和 “waiting”状态是相同的,但是有一点关键的不同:在开源 NGINX 上,“waiting”状态包括在“active”中,而在 NGINX Plus 上“idle”的连接被排除在“active” 计数外。**Current** 和开源 NGINX 是一样的也是由“reading + writing” 状态组成。

|

||||

|

||||

**Total** 为客户端请求的累积计数。请注意,单个客户端连接可涉及多个请求,所以这个数字可能会比连接的累计次数明显大。事实上,(total / accepted)是每个连接的平均请求数量。

|

||||

|

||||

**开源 和 Plus 之间指标的不同**

|

||||

|

||||

|NGINX (开源) |NGINX Plus|

|

||||

|-----------------------|----------------|

|

||||

| accepts | accepted |

|

||||

| dropped 通过计算得来| dropped 直接得到 |

|

||||

| reading + writing| current|

|

||||

| waiting| idle|

|

||||

| active (包括 “waiting”状态) | active (排除 “idle” 状态)|

|

||||

| requests| total|

|

||||

|

||||

**提醒指标: 丢弃连接**

|

||||

|

||||

被丢弃的连接数目等于 Accepts 和 Handled 之差(NGINX 中),或是可直接得到标准指标(NGINX Plus 中)。在正常情况下,丢弃连接数应该是零。如果在每个单位时间内丢弃连接的速度开始上升,那么应该看看是否资源饱和了。

|

||||

|

||||

|

||||

|

||||

**提醒指标: 每秒请求数**

|

||||

|

||||

按固定时间间隔采样你的请求数据(开源 NGINX 的**requests**或者 NGINX Plus 中**total**) 会提供给你单位时间内(通常是分钟或秒)所接受的请求数量。监测这个指标可以查看进入的 Web 流量尖峰,无论是合法的还是恶意的,或者突然的下降,这通常都代表着出现了问题。每秒请求数若发生急剧变化可以提醒你的环境出现问题了,即使它不能告诉你确切问题的位置所在。请注意,所有的请求都同样计数,无论 URL 是什么。

|

||||

|

||||

|

||||

|

||||

**收集活跃指标**

|

||||

|

||||

开源的 NGINX 提供了一个简单状态页面来显示基本的服务器指标。该状态信息以标准格式显示,实际上任何图形或监控工具可以被配置去解析这些相关数据,以用于分析、可视化、或提醒。NGINX Plus 提供一个 JSON 接口来供给更多的数据。阅读相关文章“[NGINX 指标收集][6]”来启用指标收集的功能。

|

||||

|

||||

#### 错误指标 ####

|

||||

|

||||

| 名称 | 描述| [指标类型](https://www.datadoghq.com/blog/monitoring-101-collecting-data/)| 可用于 |

|

||||

|-----------|-----------------|--------------------------------------------------------------------------------------------------------|----------------|

|

||||

| 4xx 代码 | 客户端错误计数 | 工作:错误 | NGINX 日志, NGINX Plus|

|

||||

| 5xx 代码| 服务器端错误计数 | 工作:错误 | NGINX 日志, NGINX Plus|

|

||||

|

||||

NGINX 错误指标告诉你服务器是否经常返回错误而不是正常工作。客户端错误返回4XX状态码,服务器端错误返回5XX状态码。

|

||||

|

||||

**提醒指标: 服务器错误率**

|

||||

|

||||

服务器错误率等于在单位时间(通常为一到五分钟)内5xx错误状态代码的总数除以[状态码][7](1XX,2XX,3XX,4XX,5XX)的总数。如果你的错误率随着时间的推移开始攀升,调查可能的原因。如果突然增加,可能需要采取紧急行动,因为客户端可能收到错误信息。

|

||||

|

||||

|

||||

|

||||

关于客户端错误的注意事项:虽然监控4XX是很有用的,但从该指标中你仅可以捕捉有限的信息,因为它只是衡量客户的行为而不捕捉任何特殊的 URL。换句话说,4xx出现的变化可能是一个信号,例如网络扫描器正在寻找你的网站漏洞时。

|

||||

|

||||

**收集错误度量**

|

||||

|

||||

虽然开源 NGINX 不能马上得到用于监测的错误率,但至少有两种方法可以得到:

|

||||

|

||||

- 使用商业支持的 NGINX Plus 提供的扩展状态模块

|

||||

- 配置 NGINX 的日志模块将响应码写入访问日志

|

||||

|

||||

关于这两种方法,请阅读相关文章“[NGINX 指标收集][6]”。

|

||||

|

||||

#### 性能指标 ####

|

||||

|

||||

| 名称 | 描述| [指标类型](https://www.datadoghq.com/blog/monitoring-101-collecting-data/)| 可用于 |

|

||||

|-----------|-----------------|--------------------------------------------------------------------------------------------------------|----------------|

|

||||

| request time (请求处理时间)| 处理每个请求的时间,单位为秒 | 工作:性能 | NGINX 日志|

|

||||

|

||||

**提醒指标: 请求处理时间**

|

||||

|

||||

请求处理时间指标记录了 NGINX 处理每个请求的时间,从读到客户端的第一个请求字节到完成请求。较长的响应时间说明问题在上游。

|

||||

|

||||

**收集处理时间指标**

|

||||

|

||||

NGINX 和 NGINX Plus 用户可以通过添加 $request_time 变量到访问日志格式中来捕捉处理时间数据。关于配置日志监控的更多细节在[NGINX指标收集][6]。

|

||||

|

||||

#### 反向代理指标 ####

|

||||

|

||||

| 名称 | 描述| [指标类型](https://www.datadoghq.com/blog/monitoring-101-collecting-data/)| 可用于 |

|

||||

|-----------|-----------------|--------------------------------------------------------------------------------------------------------|----------------|

|

||||

| 上游服务器的活跃链接 | 当前活跃的客户端连接 | 资源:功能 | NGINX Plus |

|

||||

| 上游服务器的 5xx 错误代码| 服务器错误 | 工作:错误 | NGINX Plus |

|

||||

| 每个上游组的可用服务器 | 服务器传递健康检查 | 资源:可用性| NGINX Plus

|

||||

|

||||

[反向代理][9]是 NGINX 最常见的使用方法之一。商业支持的 NGINX Plus 显示了大量有关后端(或“上游 upstream”)的服务器指标,这些与反向代理设置相关的。本节重点介绍了几个 NGINX Plus 用户可用的关键上游指标。

|

||||

|

||||

NGINX Plus 首先将它的上游指标按组分开,然后是针对单个服务器的。因此,例如,你的反向代理将请求分配到五个上游的 Web 服务器上,你可以一眼看出是否有单个服务器压力过大,也可以看出上游组中服务器的健康状况,以确保良好的响应时间。

|

||||

|

||||

**活跃指标**

|

||||

|

||||

**每上游服务器的活跃连接**的数量可以帮助你确认反向代理是否正确的分配工作到你的整个服务器组上。如果你正在使用 NGINX 作为负载均衡器,任何一台服务器处理的连接数的明显偏差都可能表明服务器正在努力消化请求,或者是你配置使用的负载均衡的方法(例如[round-robin 或 IP hashing][10])不是最适合你流量模式的。

|

||||

|

||||

**错误指标**

|

||||

|

||||

错误指标,上面所说的高于5XX(服务器错误)状态码,是监控指标中有价值的一个,尤其是响应码部分。 NGINX Plus 允许你轻松地提取**每个上游服务器的 5xx 错误代码**的数量,以及响应的总数量,以此来确定某个特定服务器的错误率。

|

||||

|

||||

**可用性指标**

|

||||

|

||||

对于 web 服务器的运行状况,还有另一种角度,NGINX 可以通过**每个组中当前可用服务器的总量**很方便监控你的上游组的健康。在一个大的反向代理上,你可能不会非常关心其中一个服务器的当前状态,就像你只要有可用的服务器组能够处理当前的负载就行了。但监视上游组内的所有工作的服务器总量可为判断 Web 服务器的健康状况提供一个更高层面的视角。

|

||||

|

||||

**收集上游指标**

|

||||

|

||||

NGINX Plus 上游指标显示在内部 NGINX Plus 的监控仪表盘上,并且也可通过一个JSON 接口来服务于各种外部监控平台。在我们的相关文章“[NGINX指标收集][6]”中有个例子。

|

||||

|

||||

### 结论 ###

|

||||

|

||||

在这篇文章中,我们已经谈到了一些有用的指标,你可以使用表格来监控 NGINX 服务器。如果你是刚开始使用 NGINX,监控下面提供的大部分或全部指标,可以让你很好的了解你的网络基础设施的健康和活跃程度:

|

||||

|

||||

- [已丢弃的连接][12]

|

||||

- [每秒请求数][13]

|

||||

- [服务器错误率][14]

|

||||

- [请求处理数据][15]

|

||||

|

||||

最终,你会学到更多,更专业的衡量指标,尤其是关于你自己基础设施和使用情况的。当然,监控哪一项指标将取决于你可用的工具。参见相关的文章来[逐步指导你的指标收集][6],不管你使用 NGINX 还是 NGINX Plus。

|

||||

|

||||

在 Datadog 中,我们已经集成了 NGINX 和 NGINX Plus,这样你就可以以最少的设置来收集和监控所有 Web 服务器的指标。 [在本文中][17]了解如何用 NGINX Datadog来监控,并开始[免费试用 Datadog][18]吧。

|

||||

|

||||

### 诚谢 ###

|

||||

|

||||

在文章发表之前非常感谢 NGINX 团队审阅这篇,并提供重要的反馈和说明。

|

||||

|

||||

|

||||

--------------------------------------------------------------------------------

|

||||

|

||||

via: https://www.datadoghq.com/blog/how-to-monitor-nginx/

|

||||

|

||||

作者:K Young

|

||||

译者:[strugglingyouth](https://github.com/strugglingyouth)

|

||||

校对:[wxy](https://github.com/wxy)

|

||||

|

||||

本文由 [LCTT](https://github.com/LCTT/TranslateProject) 原创翻译,[Linux中国](https://linux.cn/) 荣誉推出

|

||||

|

||||

[1]:http://nginx.org/en/

|

||||

[2]:http://nginx.com/resources/glossary/reverse-proxy-server/

|

||||

[3]:https://www.datadoghq.com/blog/monitoring-101-collecting-data/

|

||||

[4]:http://nginx.org/en/docs/ngx_core_module.html#worker_connections

|

||||

[5]:https://www.datadoghq.com/blog/how-to-monitor-nginx/#active-state

|

||||

[6]:https://www.datadoghq.com/blog/how-to-collect-nginx-metrics/

|

||||

[7]:http://www.w3.org/Protocols/rfc2616/rfc2616-sec10.html

|

||||

[8]:https://www.datadoghq.com/blog/how-to-collect-nginx-metrics/

|

||||

[9]:https://en.wikipedia.org/wiki/Reverse_proxy

|

||||

[10]:http://nginx.com/blog/load-balancing-with-nginx-plus/

|

||||

[11]:https://www.datadoghq.com/blog/how-to-collect-nginx-metrics/

|

||||

[12]:https://www.datadoghq.com/blog/how-to-monitor-nginx/#dropped-connections

|

||||

[13]:https://www.datadoghq.com/blog/how-to-monitor-nginx/#requests-per-second

|

||||

[14]:https://www.datadoghq.com/blog/how-to-monitor-nginx/#server-error-rate

|

||||

[15]:https://www.datadoghq.com/blog/how-to-monitor-nginx/#request-processing-time

|

||||

[16]:https://www.datadoghq.com/blog/how-to-collect-nginx-metrics/

|

||||

[17]:https://www.datadoghq.com/blog/how-to-monitor-nginx-with-datadog/

|

||||

[18]:https://www.datadoghq.com/blog/how-to-monitor-nginx/#sign-up

|

||||

[19]:https://github.com/DataDog/the-monitor/blob/master/nginx/how_to_monitor_nginx.md

|

||||

[20]:https://github.com/DataDog/the-monitor/issues

|

||||

@ -5,10 +5,12 @@

|

||||

我试着在Ubuntu中安装Emerald图标主题,而这个主题被打包成了.7z归档包。和以往一样,我试着通过在GUI中右击并选择“提取到这里”来将它解压缩。但是Ubuntu 15.04却并没有解压文件,取而代之的,却是丢给了我一个下面这样的错误信息:

|

||||

|

||||

> Could not open this file

|

||||

>

|

||||

> 无法打开该文件

|

||||

>

|

||||

> There is no command installed for 7-zip archive files. Do you want to search for a command to open this file?

|

||||

> 没有安装用于7-zip归档文件的命令。你是否想要搜索命令来打开该文件?

|

||||

>

|

||||

> 没有安装用于7-zip归档文件的命令。你是否想要搜索用于来打开该文件的命令?

|

||||

|

||||

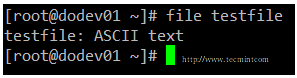

错误信息看上去是这样的:

|

||||

|

||||

@ -42,7 +44,7 @@ via: http://itsfoss.com/fix-there-is-no-command-installed-for-7-zip-archive-file

|

||||

|

||||

作者:[Abhishek][a]

|

||||

译者:[GOLinux](https://github.com/GOLinux)

|

||||

校对:[校对者ID](https://github.com/校对者ID)

|

||||

校对:[wxy](https://github.com/wxy)

|

||||

|

||||

本文由 [LCTT](https://github.com/LCTT/TranslateProject) 原创翻译,[Linux中国](https://linux.cn/) 荣誉推出

|

||||

|

||||

@ -1,16 +1,16 @@

|

||||

在Linux中利用"Explain Shell"脚本更容易地理解Shell命令

|

||||

轻松使用“Explain Shell”脚本来理解 Shell 命令

|

||||

================================================================================

|

||||

在某些时刻, 当我们在Linux平台上工作时我们所有人都需要shell命令的帮助信息。 尽管内置的帮助像man pages、whatis命令是有帮助的, 但man pages的输出非常冗长, 除非是个有linux经验的人,不然从大量的man pages中获取帮助信息是非常困难的,而whatis命令的输出很少超过一行, 这对初学者来说是不够的。

|

||||

我们在Linux上工作时,每个人都会遇到需要查找shell命令的帮助信息的时候。 尽管内置的帮助像man pages、whatis命令有所助益, 但man pages的输出非常冗长, 除非是个有linux经验的人,不然从大量的man pages中获取帮助信息是非常困难的,而whatis命令的输出很少超过一行, 这对初学者来说是不够的。

|

||||

|

||||

|

||||

|

||||

在Linux Shell中解释Shell命令

|

||||

*在Linux Shell中解释Shell命令*

|

||||

|

||||

有一些第三方应用程序, 像我们在[Commandline Cheat Sheet for Linux Users][1]提及过的'cheat'命令。Cheat是个杰出的应用程序,即使计算机没有联网也能提供shell命令的帮助, 但是它仅限于预先定义好的命令。

|

||||

有一些第三方应用程序, 像我们在[Linux 用户的命令行速查表][1]提及过的'cheat'命令。cheat是个优秀的应用程序,即使计算机没有联网也能提供shell命令的帮助, 但是它仅限于预先定义好的命令。

|

||||

|

||||

Jackson写了一小段代码,它能非常有效地在bash shell里面解释shell命令,可能最美之处就是你不需要安装第三方包了。他把包含这段代码的的文件命名为”explain.sh“。

|

||||

Jackson写了一小段代码,它能非常有效地在bash shell里面解释shell命令,可能最美之处就是你不需要安装第三方包了。他把包含这段代码的的文件命名为“explain.sh”。

|

||||

|

||||

#### Explain工具的特性 ####

|

||||

#### explain.sh工具的特性 ####

|

||||

|

||||

- 易嵌入代码。

|

||||

- 不需要安装第三方工具。

|

||||

@ -18,22 +18,22 @@ Jackson写了一小段代码,它能非常有效地在bash shell里面解释she

|

||||

- 需要网络连接才能工作。

|

||||

- 纯命令行工具。

|

||||

- 可以解释bash shell里面的大部分shell命令。

|

||||

- 无需root账户参与。

|

||||

- 无需使用root账户。

|

||||

|

||||

**先决条件**

|

||||

|

||||

唯一的条件就是'curl'包了。 在如今大多数Linux发行版里面已经预安装了culr包, 如果没有你可以按照下面的命令来安装。

|

||||

唯一的条件就是'curl'包了。 在如今大多数Linux发行版里面已经预安装了curl包, 如果没有你可以按照下面的命令来安装。

|

||||

|

||||

# apt-get install curl [On Debian systems]

|

||||

# yum install curl [On CentOS systems]

|

||||

|

||||

### 在Linux上安装explain.sh工具 ###

|

||||

|

||||

我们要将下面这段代码插入'~/.bashrc'文件(LCTT注: 若没有该文件可以自己新建一个)中。我们必须为每个用户以及对应的'.bashrc'文件插入这段代码,笔者建议你不要加在root用户下。

|

||||

我们要将下面这段代码插入'~/.bashrc'文件(LCTT译注: 若没有该文件可以自己新建一个)中。我们要为每个用户以及对应的'.bashrc'文件插入这段代码,但是建议你不要加在root用户下。

|

||||

|

||||

我们注意到.bashrc文件的第一行代码以(#)开始, 这个是可选的并且只是为了区分余下的代码。

|

||||

|

||||

# explain.sh 标记代码的开始, 我们将代码插入.bashrc文件的底部。

|

||||

\# explain.sh 标记代码的开始, 我们将代码插入.bashrc文件的底部。

|

||||

|

||||

# explain.sh begins

|

||||

explain () {

|

||||

@ -53,7 +53,7 @@ Jackson写了一小段代码,它能非常有效地在bash shell里面解释she

|

||||

|

||||

### explain.sh工具的使用 ###

|

||||

|

||||

在插入代码并保存之后,你必须退出当前的会话然后重新登录来使改变生效(LCTT注:你也可以直接使用命令“source~/.bashrc”来让改变生效)。每件事情都是交由‘curl’命令处理, 它负责将需要解释的命令以及命令选项传送给mankier服务,然后将必要的信息打印到Linux命令行。不必说的就是使用这个工具你总是需要连接网络。

|

||||

在插入代码并保存之后,你必须退出当前的会话然后重新登录来使改变生效(LCTT译注:你也可以直接使用命令`source~/.bashrc` 来让改变生效)。每件事情都是交由‘curl’命令处理, 它负责将需要解释的命令以及命令选项传送给mankier服务,然后将必要的信息打印到Linux命令行。不必说的就是使用这个工具你总是需要连接网络。

|

||||

|

||||

让我们用explain.sh脚本测试几个笔者不懂的命令例子。

|

||||

|

||||

@ -63,7 +63,7 @@ Jackson写了一小段代码,它能非常有效地在bash shell里面解释she

|

||||

|

||||

|

||||

|

||||

获得du命令的帮助

|

||||

*获得du命令的帮助*

|

||||

|

||||

**2.如果你忘了'tar -zxvf'的作用,你可以简单地如此做:**

|

||||

|

||||

@ -71,7 +71,7 @@ Jackson写了一小段代码,它能非常有效地在bash shell里面解释she

|

||||

|

||||

|

||||

|

||||

Tar命令帮助

|

||||

*Tar命令帮助*

|

||||

|

||||

**3.我的一个朋友经常对'whatis'以及'whereis'命令的使用感到困惑,所以我建议他:**

|

||||

|

||||

@ -86,7 +86,7 @@ Tar命令帮助

|

||||

|

||||

|

||||

|

||||

Whatis/Whereis命令的帮助

|

||||

*Whatis/Whereis命令的帮助*

|

||||

|

||||

你只需要使用“Ctrl+c”就能退出交互模式。

|

||||

|

||||

@ -96,11 +96,11 @@ Whatis/Whereis命令的帮助

|

||||

|

||||

|

||||

|

||||

获取多条命令的帮助

|

||||

*获取多条命令的帮助*

|

||||

|

||||

同样地,你可以请求你的shell来解释任何shell命令。 前提是你需要一个可用的网络。输出的信息是基于解释的需要从服务器中生成的,因此输出的结果是不可定制的。

|

||||

同样地,你可以请求你的shell来解释任何shell命令。 前提是你需要一个可用的网络。输出的信息是基于需要解释的命令,从服务器中生成的,因此输出的结果是不可定制的。

|

||||

|

||||

对于我来说这个工具真的很有用并且它已经荣幸地添加在我的.bashrc文件中。你对这个项目有什么想法?它对你有用么?它的解释令你满意吗?请让我知道吧!

|

||||

对于我来说这个工具真的很有用,并且它已经荣幸地添加在我的.bashrc文件中。你对这个项目有什么想法?它对你有用么?它的解释令你满意吗?请让我知道吧!

|

||||

|

||||

请在下面评论为我们提供宝贵意见,喜欢并分享我们以及帮助我们得到传播。

|

||||

|

||||

@ -110,7 +110,7 @@ via: http://www.tecmint.com/explain-shell-commands-in-the-linux-shell/

|

||||

|

||||

作者:[Avishek Kumar][a]

|

||||

译者:[dingdongnigetou](https://github.com/dingdongnigetou)

|

||||

校对:[校对者ID](https://github.com/校对者ID)

|

||||

校对:[wxy](https://github.com/wxy)

|

||||

|

||||

本文由 [LCTT](https://github.com/LCTT/TranslateProject) 原创翻译,[Linux中国](https://linux.cn/) 荣誉推出

|

||||

|

||||

@ -1,11 +1,12 @@

|

||||

新手应知应会的Linux命令

|

||||

================================================================================

|

||||

|

||||

在Fedora上通过命令行使用dnf来管理系统更新

|

||||

|

||||

基于Linux的系统的优点之一,就是你可以通过终端中使用命令该ing来管理整个系统。使用命令行的优势在于,你可以使用相同的知识和技能来管理随便哪个Linux发行版。

|

||||

*在Fedora上通过命令行使用dnf来管理系统更新*

|

||||

|

||||

对于各个发行版以及桌面环境(DE)而言,要一致地使用图形化用户界面(GUI)却几乎是不可能的,因为它们都提供了各自的用户界面。要明确的是,有那么些情况,你需要在不同的发行版上使用不同的命令来部署某些特定的任务,但是,或多或少它们的概念和意图却仍然是一致的。

|

||||

基于Linux的系统最美妙的一点,就是你可以在终端中使用命令行来管理整个系统。使用命令行的优势在于,你可以使用相同的知识和技能来管理随便哪个Linux发行版。

|

||||

|

||||

对于各个发行版以及桌面环境(DE)而言,要一致地使用图形化用户界面(GUI)却几乎是不可能的,因为它们都提供了各自的用户界面。要明确的是,有些情况下在不同的发行版上需要使用不同的命令来执行某些特定的任务,但是,基本来说它们的思路和目的是一致的。

|

||||

|

||||

在本文中,我们打算讨论Linux用户应当掌握的一些基本命令。我将给大家演示怎样使用命令行来更新系统、管理软件、操作文件以及切换到root,这些操作将在三个主要发行版上进行:Ubuntu(也包括其定制版和衍生版,还有Debian),openSUSE,以及Fedora。

|

||||

|

||||

@ -15,7 +16,7 @@

|

||||

|

||||

Linux是基于安全设计的,但事实上是,任何软件都有缺陷,会导致安全漏洞。所以,保持你的系统更新到最新是十分重要的。这么想吧:运行过时的操作系统,就像是你坐在全副武装的坦克里头,而门却没有锁。武器会保护你吗?任何人都可以进入开放的大门,对你造成伤害。同样,在你的系统中也有没有打补丁的漏洞,这些漏洞会危害到你的系统。开源社区,不像专利世界,在漏洞补丁方面反应是相当快的,所以,如果你保持系统最新,你也获得了安全保证。

|

||||

|

||||

留意新闻站点,了解安全漏洞。如果发现了一个漏洞,请阅读之,然后在补丁出来的第一时间更新。不管怎样,在生产机器上,你每星期必须至少运行一次更新命令。如果你运行这一台复杂的服务器,那么就要额外当心了。仔细阅读变更日志,以确保更新不会搞坏你的自定义服务。

|

||||

留意新闻站点,了解安全漏洞。如果发现了一个漏洞,了解它,然后在补丁出来的第一时间更新。不管怎样,在生产环境上,你每星期必须至少运行一次更新命令。如果你运行着一台复杂的服务器,那么就要额外当心了。仔细阅读变更日志,以确保更新不会搞坏你的自定义服务。

|

||||

|

||||

**Ubuntu**:牢记一点:你在升级系统或安装不管什么软件之前,都必须要刷新仓库(也就是repos)。在Ubuntu上,你可以使用下面的命令来更新系统,第一个命令用于刷新仓库:

|

||||

|

||||

@ -29,7 +30,7 @@ Linux是基于安全设计的,但事实上是,任何软件都有缺陷,会

|

||||

|

||||

sudo apt-get dist-upgrade

|

||||

|

||||

**openSUSE**:如果你是在openSUSE上,你可以使用以下命令来更新系统(照例,第一个命令的意思是更新仓库)

|

||||

**openSUSE**:如果你是在openSUSE上,你可以使用以下命令来更新系统(照例,第一个命令的意思是更新仓库):

|

||||

|

||||

sudo zypper refresh

|

||||

sudo zypper up

|

||||

@ -42,7 +43,7 @@ Linux是基于安全设计的,但事实上是,任何软件都有缺陷,会

|

||||

### 软件安装与移除 ###

|

||||

|

||||

你只可以安装那些你系统上启用的仓库中可用的包,各个发行版默认都附带有并启用了一些官方或者第三方仓库。

|

||||

**Ubuntu**: To install any package on Ubuntu, first update the repo and then use this syntax:

|

||||

|

||||

**Ubuntu**:要在Ubuntu上安装包,首先更新仓库,然后使用下面的语句:

|

||||

|

||||

sudo apt-get install [package_name]

|

||||

@ -75,9 +76,9 @@ Linux是基于安全设计的,但事实上是,任何软件都有缺陷,会

|

||||

|

||||

### 如何管理第三方软件? ###

|

||||

|

||||

在一个庞大的开发者社区中,这些开发者们为用户提供了许多的软件。不同的发行版有不同的机制来使用这些第三方软件,将它们提供给用户。同时也取决于开发者怎样将这些软件提供给用户,有些开发者会提供二进制包,而另外一些开发者则将软件发布到仓库中。

|

||||

在一个庞大的开发者社区中,这些开发者们为用户提供了许多的软件。不同的发行版有不同的机制来将这些第三方软件提供给用户。当然,同时也取决于开发者怎样将这些软件提供给用户,有些开发者会提供二进制包,而另外一些开发者则将软件发布到仓库中。

|

||||

|

||||

Ubuntu严重依赖于PPA(个人包归档),但是,不幸的是,它却没有提供一个内建工具来帮助用于搜索这些PPA仓库。在安装软件前,你将需要通过Google搜索PPA,然后手工添加该仓库。下面就是添加PPA到系统的方法:

|

||||

Ubuntu很多地方都用到PPA(个人包归档),但是,不幸的是,它却没有提供一个内建工具来帮助用于搜索这些PPA仓库。在安装软件前,你将需要通过Google搜索PPA,然后手工添加该仓库。下面就是添加PPA到系统的方法:

|

||||

|

||||

sudo add-apt-repository ppa:<repository-name>

|

||||

|

||||

@ -85,7 +86,7 @@ Ubuntu严重依赖于PPA(个人包归档),但是,不幸的是,它却

|

||||

|

||||

sudo add-apt-repository ppa:libreoffice/ppa

|

||||

|

||||

它会要你按下回车键来导入秘钥。完成后,使用'update'命令来刷新仓库,然后安装该包。

|

||||

它会要你按下回车键来导入密钥。完成后,使用'update'命令来刷新仓库,然后安装该包。

|

||||

|

||||

openSUSE拥有一个针对第三方应用的优雅的解决方案。你可以访问software.opensuse.org,一键点击搜索并安装相应包,它会自动将对应的仓库添加到你的系统中。如果你想要手工添加仓库,可以使用该命令:

|

||||

|

||||

@ -97,13 +98,13 @@ openSUSE拥有一个针对第三方应用的优雅的解决方案。你可以访

|

||||

sudo zypper refresh

|

||||

sudo zypper install libreoffice

|

||||

|

||||

Fedora用户只需要添加RPMFusion(free和non-free仓库一起),该仓库包含了大量的应用。如果你需要添加仓库,命令如下:

|

||||

Fedora用户只需要添加RPMFusion(包括自由软件和非自由软件仓库),该仓库包含了大量的应用。如果你需要添加该仓库,命令如下:

|

||||

|

||||

dnf config-manager --add-repo http://www.example.com/example.repo

|

||||

dnf config-manager --add-repo http://www.example.com/example.repo

|

||||

|

||||

### 一些基本命令 ###

|

||||

|

||||

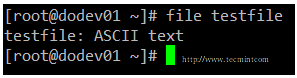

我已经写了一些关于使用CLI来管理你系统上的文件的[文章][1],下面介绍一些基本米ing令,这些命令在所有发行版上都经常会用到。

|

||||

我已经写了一些关于使用CLI来管理你系统上的文件的[文章][1],下面介绍一些基本命令,这些命令在所有发行版上都经常会用到。

|

||||

|

||||

拷贝文件或目录到一个新的位置:

|

||||

|

||||

@ -113,13 +114,13 @@ dnf config-manager --add-repo http://www.example.com/example.repo

|

||||

|

||||

cp path_of_files/* path_of_the_directory_where_you_want_to_copy/

|

||||

|

||||

将一个文件从某个位置移动到另一个位置(尾斜杠是说在该目录中):

|

||||

将一个文件从某个位置移动到另一个位置(尾斜杠是说放在该目录中):

|

||||

|

||||

mv path_of_file_1 path_of_the_directory_where_you_want_to_move/

|

||||

mv path_of_file_1 path_of_the_directory_where_you_want_to_move/

|

||||

|

||||

将所有文件从一个位置移动到另一个位置:

|

||||

|

||||

mv path_of_directory_where_files_are/* path_of_the_directory_where_you_want_to_move/

|

||||

mv path_of_directory_where_files_are/* path_of_the_directory_where_you_want_to_move/

|

||||

|

||||

删除一个文件:

|

||||

|

||||

@ -135,11 +136,11 @@ dnf config-manager --add-repo http://www.example.com/example.repo

|

||||

|

||||

### 创建新目录 ###

|

||||

|

||||

要创建一个新目录,首先输入你要创建的目录的位置。比如说,你想要在你的Documents目录中创建一个名为'foundation'的文件夹。让我们使用 cd (即change directory,改变目录)命令来改变目录:

|

||||

要创建一个新目录,首先进入到你要创建该目录的位置。比如说,你想要在你的Documents目录中创建一个名为'foundation'的文件夹。让我们使用 cd (即change directory,改变目录)命令来改变目录:

|

||||

|

||||

cd /home/swapnil/Documents

|

||||

|

||||

(替换'swapnil'为你系统中的用户)

|

||||

(替换'swapnil'为你系统中的用户名)

|

||||

|

||||

然后,使用 mkdir 命令来创建该目录:

|

||||

|

||||

@ -149,13 +150,13 @@ dnf config-manager --add-repo http://www.example.com/example.repo

|

||||

|

||||

mdkir /home/swapnil/Documents/foundation

|

||||

|

||||

如果你想要创建父-子目录,那是指目录中的目录,那么可以使用 -p 选项。它会在指定路径中创建所有目录:

|

||||

如果你想要连父目录一起创建,那么可以使用 -p 选项。它会在指定路径中创建所有目录:

|

||||

|

||||

mdkir -p /home/swapnil/Documents/linux/foundation

|

||||

|

||||

### 成为root ###

|

||||

|

||||

你或许需要成为root,或者具有sudo权力的用户,来实施一些管理任务,如管理软件包或者对根目录或其下的文件进行一些修改。其中一个例子就是编辑'fstab'文件,该文件记录了挂载的硬件驱动器。它在'etc'目录中,而该目录又在根目录中,你只能作为超级用户来修改该文件。在大多数的发行版中,你可以通过'切换用户'来成为root。比如说,在openSUSE上,我想要成为root,因为我要在根目录中工作,你可以使用下面的命令之一:

|

||||

你或许需要成为root,或者具有sudo权力的用户,来实施一些管理任务,如管理软件包或者对根目录或其下的文件进行一些修改。其中一个例子就是编辑'fstab'文件,该文件记录了挂载的硬盘驱动器。它在'etc'目录中,而该目录又在根目录中,你只能作为超级用户来修改该文件。在大多数的发行版中,你可以通过'su'来成为root。比如说,在openSUSE上,我想要成为root,因为我要在根目录中工作,你可以使用下面的命令之一:

|

||||

|

||||

sudo su -

|

||||

|

||||

@ -165,7 +166,7 @@ dnf config-manager --add-repo http://www.example.com/example.repo

|

||||

|

||||

该命令会要求输入密码,然后你就具有root特权了。记住一点:千万不要以root用户来运行系统,除非你知道你正在做什么。另外重要的一点需要注意的是,你以root什么对目录或文件进行修改后,会将它们的拥有关系从该用户或特定的服务改变为root。你必须恢复这些文件的拥有关系,否则该服务或用户就不能访问或写入到那些文件。要改变用户,命令如下:

|

||||

|

||||

sudo chown -R user:user /path_of_file_or_directory

|

||||

sudo chown -R 用户:组 文件或目录名

|

||||

|

||||

当你将其它发行版上的分区挂载到系统中时,你可能经常需要该操作。当你试着访问这些分区上的文件时,你可能会碰到权限拒绝错误,你只需要改变这些分区的拥有关系就可以访问它们了。需要额外当心的是,不要改变根目录的权限或者拥有关系。

|

||||

|

||||

@ -177,7 +178,7 @@ via: http://www.linux.com/learn/tutorials/842251-must-know-linux-commands-for-ne

|

||||

|

||||

作者:[Swapnil Bhartiya][a]

|

||||

译者:[GOLinux](https://github.com/GOLinux)

|

||||

校对:[校对者ID](https://github.com/校对者ID)

|

||||

校对:[wxy](https://github.com/wxy)

|

||||

|

||||

本文由 [LCTT](https://github.com/LCTT/TranslateProject) 原创翻译,[Linux中国](https://linux.cn/) 荣誉推出

|

||||

|

||||

@ -0,0 +1,65 @@

|

||||

使用 Find 命令来帮你找到那些需要清理的文件

|

||||

================================================================================

|

||||

|

||||

|

||||

*Credit: Sandra H-S*

|

||||

|

||||

有一个问题几乎困扰着所有的文件系统 -- 包括 Unix 和其他的 -- 那就是文件的不断积累。几乎没有人愿意花时间清理掉他们不再使用的文件和整理文件系统,结果,文件变得很混乱,很难找到有用的东西,要使它们运行良好、维护备份、易于管理,这将是一种持久的挑战。

|

||||

|

||||

我见过的一种解决问题的方法是建议使用者将所有的数据碎屑创建一个文件集合的总结报告或"概况",来报告诸如所有的文件数量;最老的,最新的,最大的文件;并统计谁拥有这些文件等数据。如果有人看到五年前的一个包含五十万个文件的文件夹,他们可能会去删除哪些文件 -- 或者,至少会归档和压缩。主要问题是太大的文件夹会使人担心误删一些重要的东西。如果有一个描述文件夹的方法能帮助显示文件的性质,那么你就可以去清理它了。

|

||||

|

||||

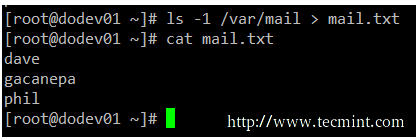

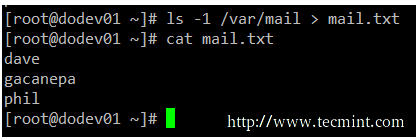

当我准备做 Unix 文件系统的总结报告时,几个有用的 Unix 命令能提供一些非常有用的统计信息。要计算目录中的文件数,你可以使用这样一个 find 命令。

|

||||

|

||||

$ find . -type f | wc -l

|

||||

187534

|

||||

|

||||

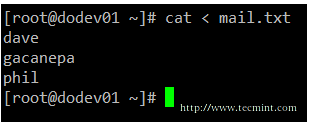

虽然查找最老的和最新的文件是比较复杂,但还是相当方便的。在下面的命令,我们使用 find 命令再次查找文件,以文件时间排序并按年-月-日的格式显示,在列表顶部的显然是最老的。

|

||||

|

||||